Azure AI Foundry

Azure AI Foundry est une plateforme dans Azure pour le développement, le déploiement et la gestion d'applications, d'agents et de modèles d'IA. Dans le cadre de Siesta AI, elle sert de backend d'entreprise pour l'inférence et les agents avec support RBAC, restrictions régionales et audits.

Aperçu

Siesta AI de Azure AI Foundry :

- appelle des modèles déployés (chat, raisonnement, transcription),

- utilise un point de terminaison compatible avec OpenAI pour l'inférence,

- respecte les politiques de sécurité et RBAC d'Azure du client.

Concepts de base

- Ressource Foundry – ressource Azure de type Azure AI Foundry dans un abonnement et un groupe de ressources.

- Projet Foundry – projet logique à l'intérieur de la ressource Foundry (séparation des équipes, des applications et des environnements).

- Point de terminaison de projet – point de terminaison API pour les capacités du projet (agents, évaluations, inférence via l'API Foundry).

- Déploiement de modèle – déploiement spécifique d'un modèle (par exemple,

gpt-5.2,gpt-5.2-chat). - Clé API – clé pour l'authentification des appels à l'API Foundry.

Exigences

- Abonnement Azure actif.

- Autorisation minimale de Contributeur sur le groupe de ressources cible.

- Fournisseur de ressources enregistré Microsoft.Foundry.

- Accès à ai.azure.com (Microsoft Entra ID).

Création d'Azure AI Foundry

1) Ressource Foundry

- Connectez-vous au Portail Azure.

- Créez une nouvelle ressource Azure AI Foundry.

- Choisissez Abonnement, Groupe de ressources, Région (par exemple,

westeurope) et nommez la ressource (par exemple,aif-sai-pro).

La ressource Foundry sert de conteneur pour tous les projets.

2) Projet Foundry

- Ouvrez ai.azure.com.

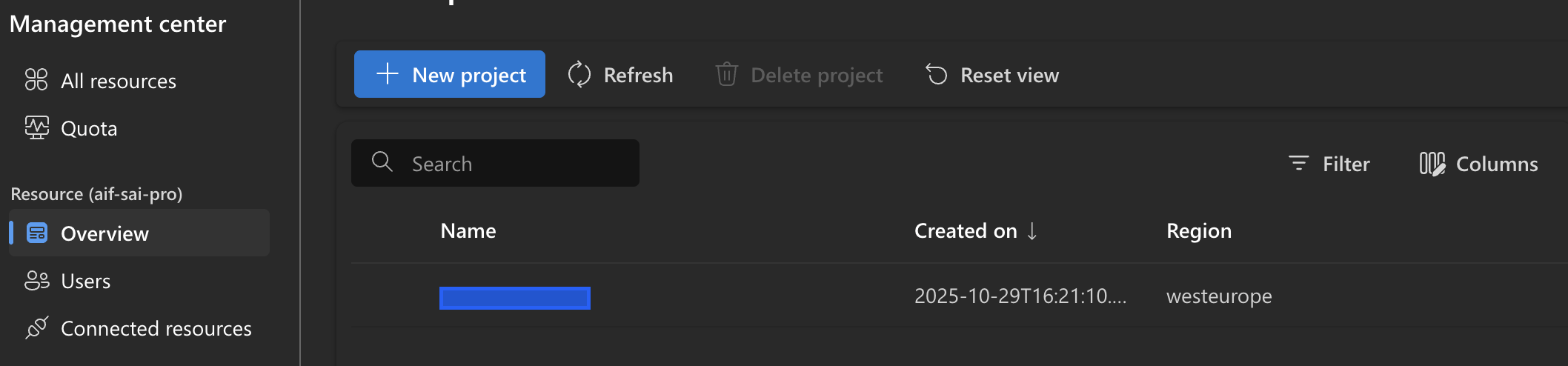

- À gauche, sélectionnez Centre de gestion → Projets.

- Cliquez sur Nouveau projet.

- Sélectionnez la ressource Foundry existante et entrez le nom du projet.

Déploiement de modèles

Déploiements de modèles

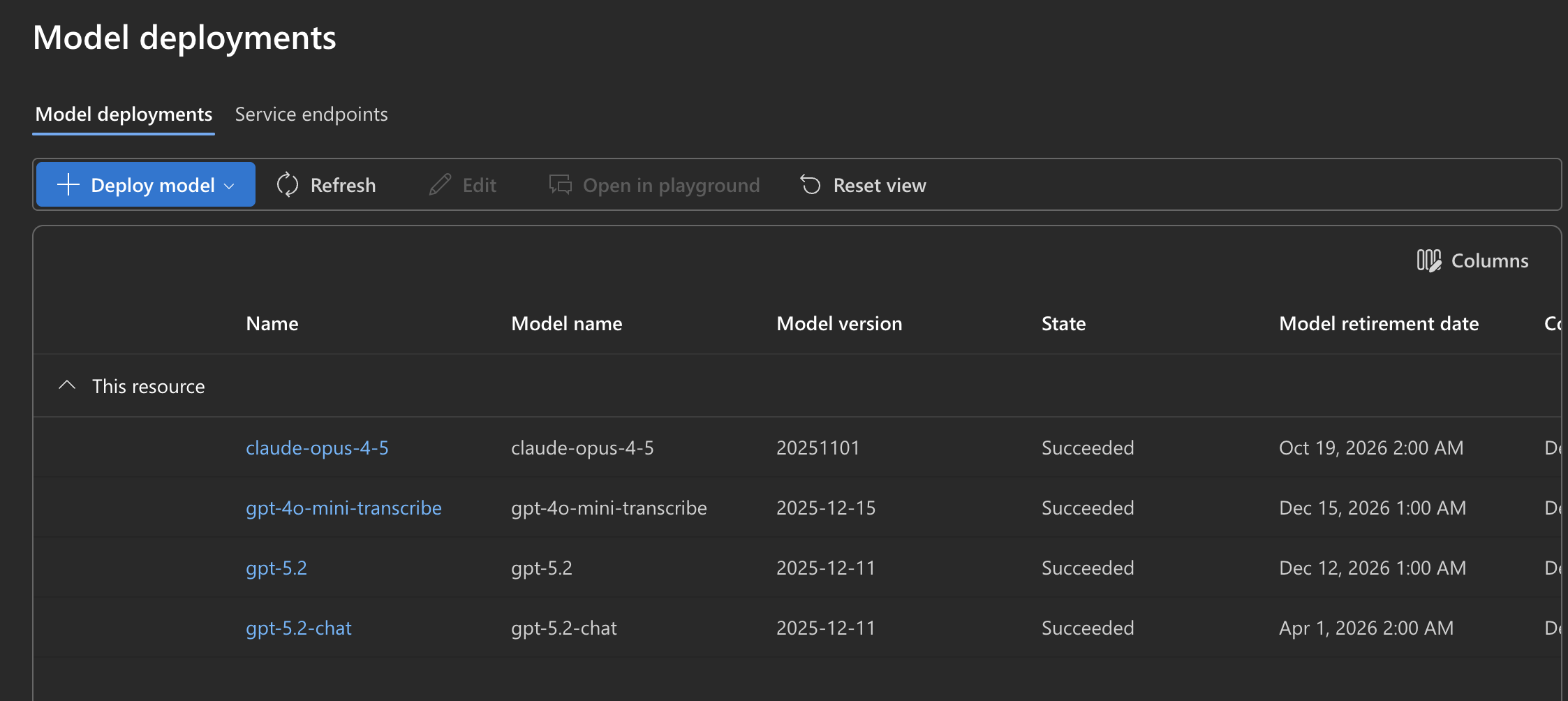

Dans le projet, allez à Catalogue de modèles → Déploiements de modèles et déployez les modèles disponibles.

Exemples de déploiements :

gpt-5.2gpt-5.2-chatgpt-4o-mini-transcribeclaude-opus-4-5

Chaque déploiement a un nom de déploiement, une version de modèle, un état et une date de retrait.

⚠️ Siesta AI travaille avec le nom de déploiement, pas avec le nom du modèle.

Points de terminaison et clés API

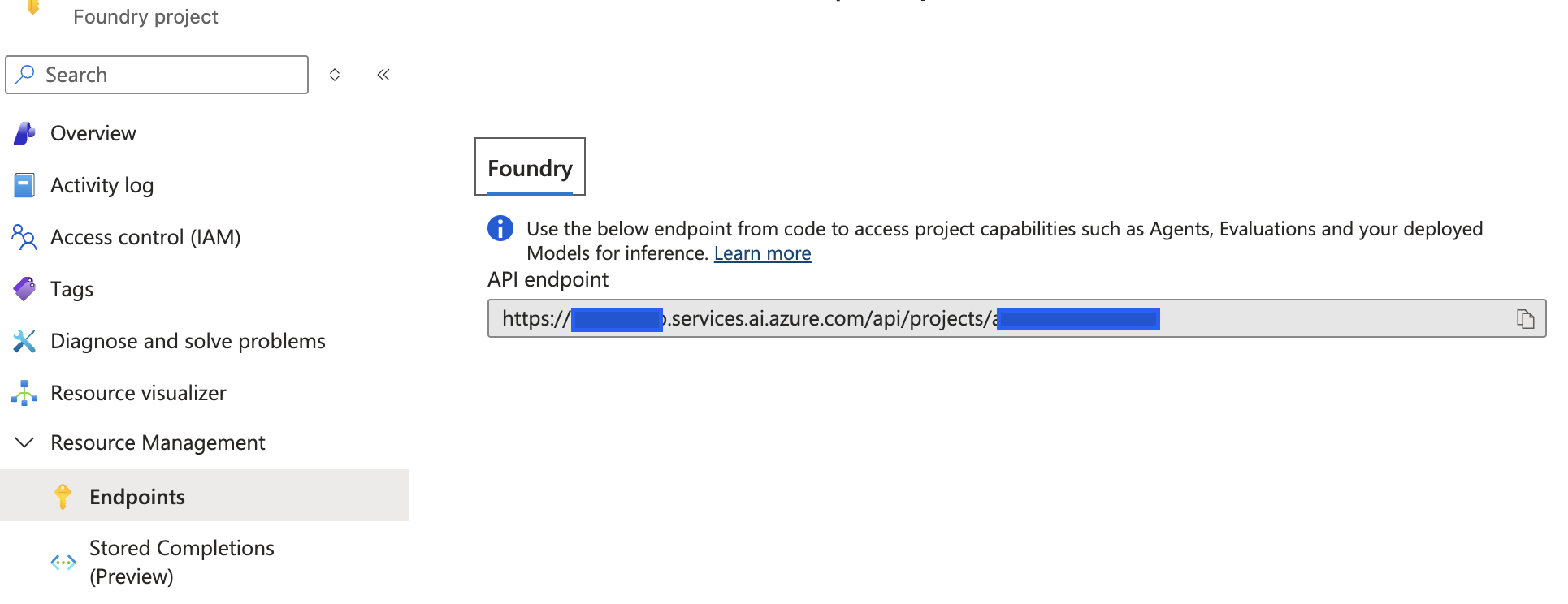

Point de terminaison de projet (API Foundry)

Le point de terminaison de projet sert pour les capacités du projet (agents, évaluations et API d'inférence Foundry). Vous le trouverez dans les détails du projet.

Format du point de terminaison :

https://<nom-de-ressource-foundry>.services.ai.azure.com/api/projects/<id-ou-nom-de-projet>

Points de terminaison et clés dans le projet

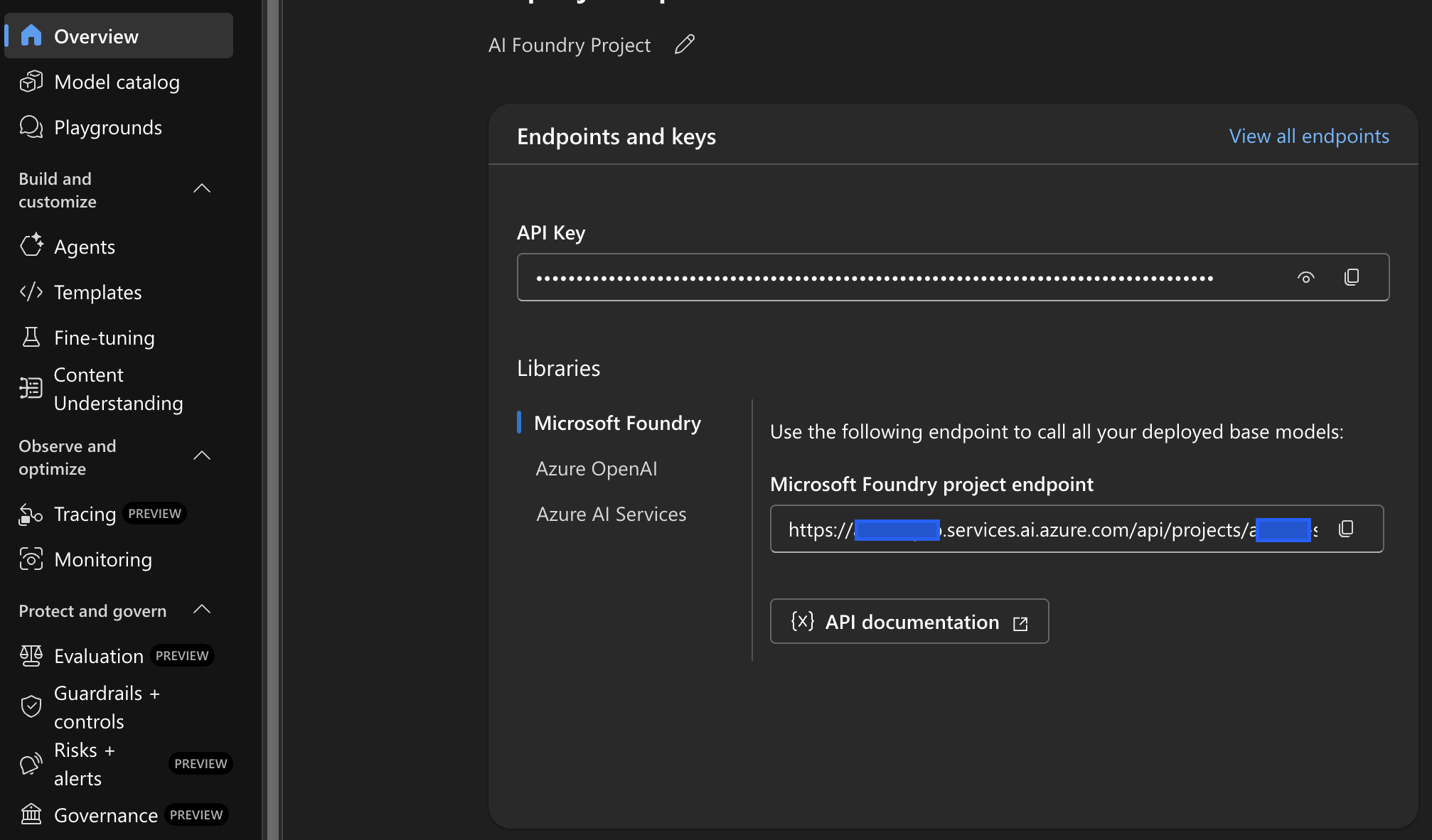

Dans ai.azure.com, ouvrez le projet et la section Points de terminaison et clés :

- Point de terminaison de projet Microsoft Foundry

- Clé API pour le projet

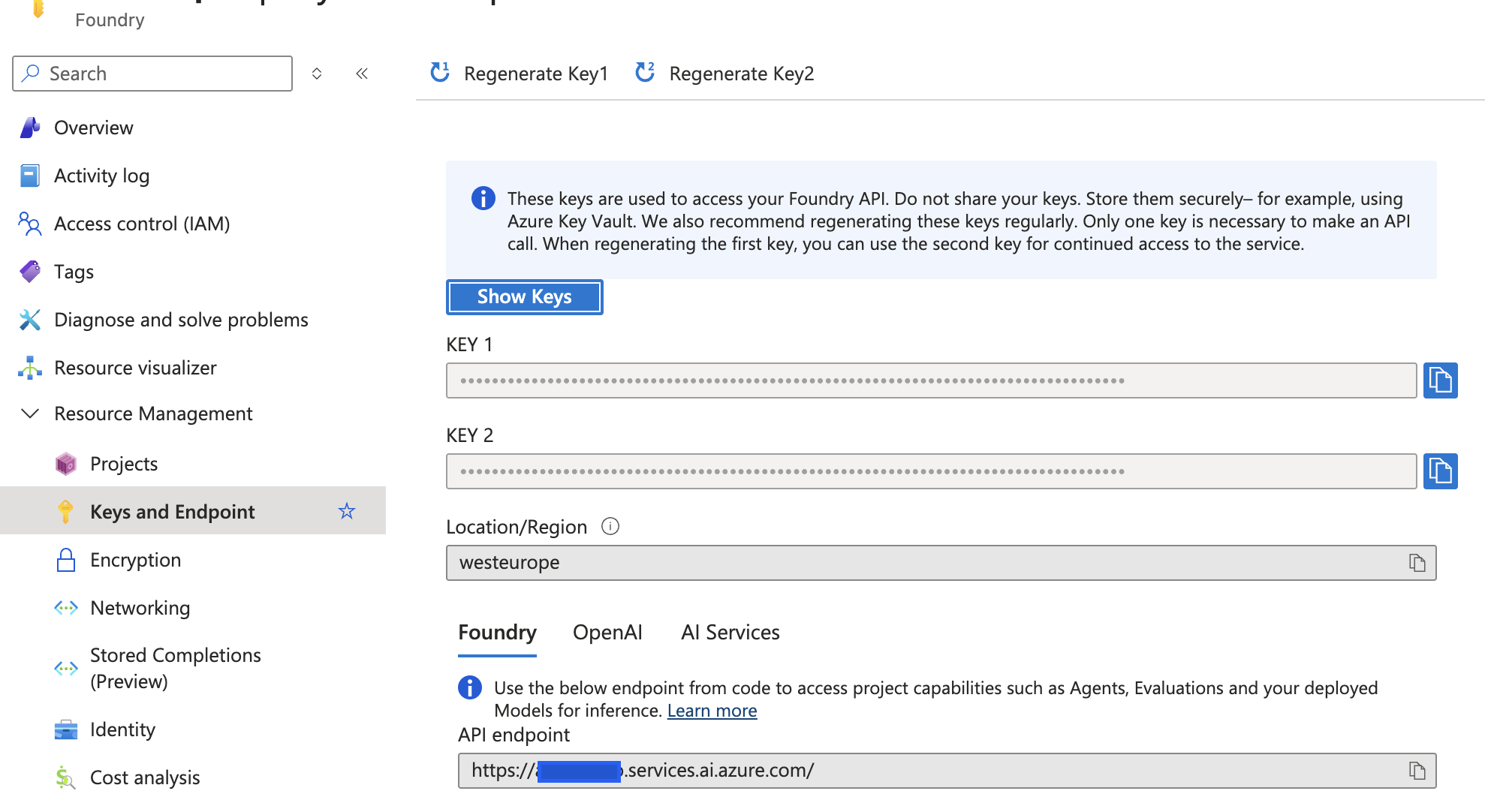

Clés et Point de terminaison (Portail Azure)

Dans le Portail Azure sur la ressource Foundry :

- Clés et Point de terminaison → Foundry

- Clé 1 / Clé 2 pour la rotation

- Point de terminaison de base de la ressource

Connexion d'Azure AI Foundry à Siesta AI

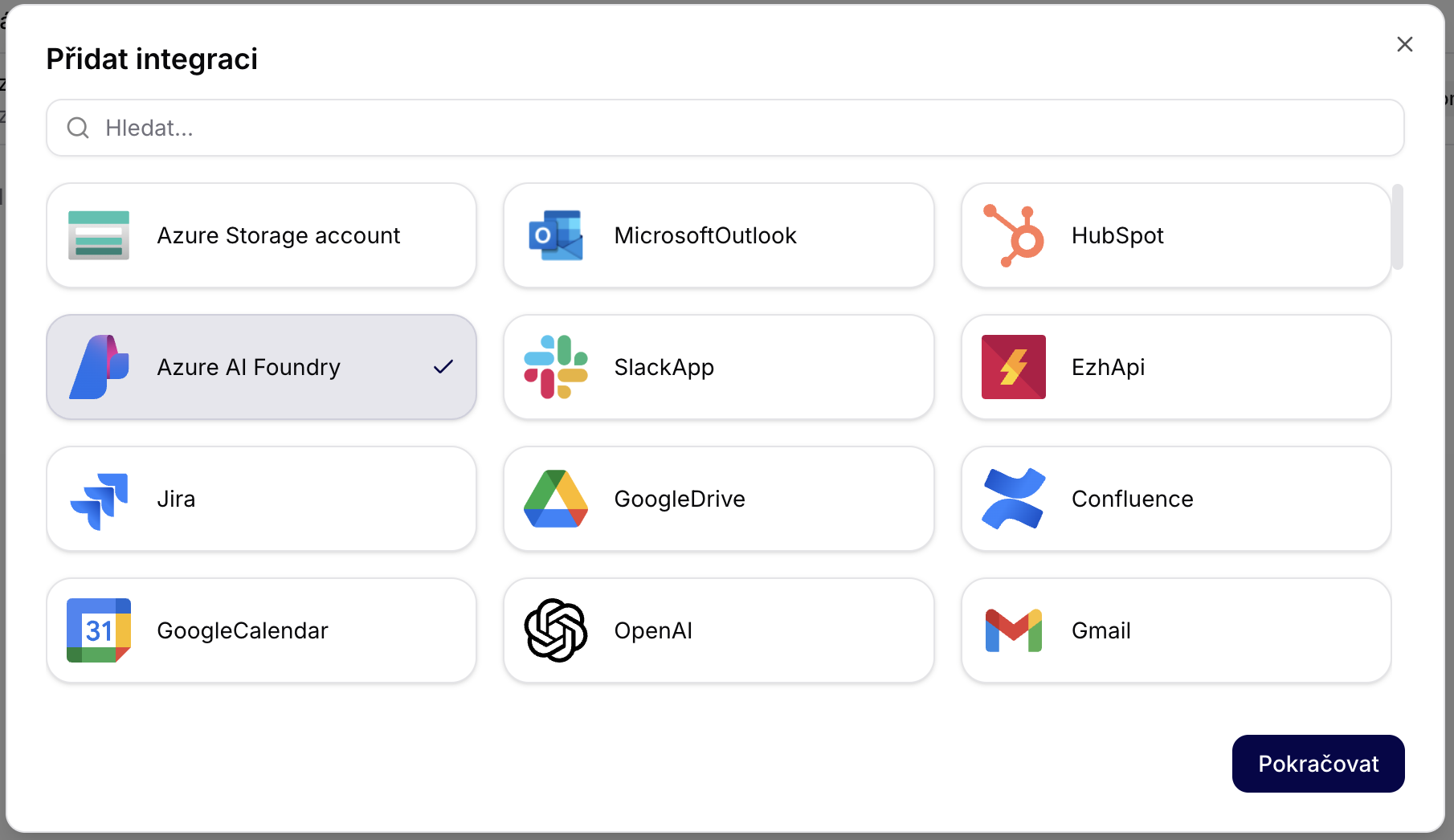

1) Ajout de l'intégration

- Connectez-vous à Siesta AI Admin.

- Ouvrez Intégrations.

- Cliquez sur Ajouter une intégration.

- Sélectionnez Azure AI Foundry.

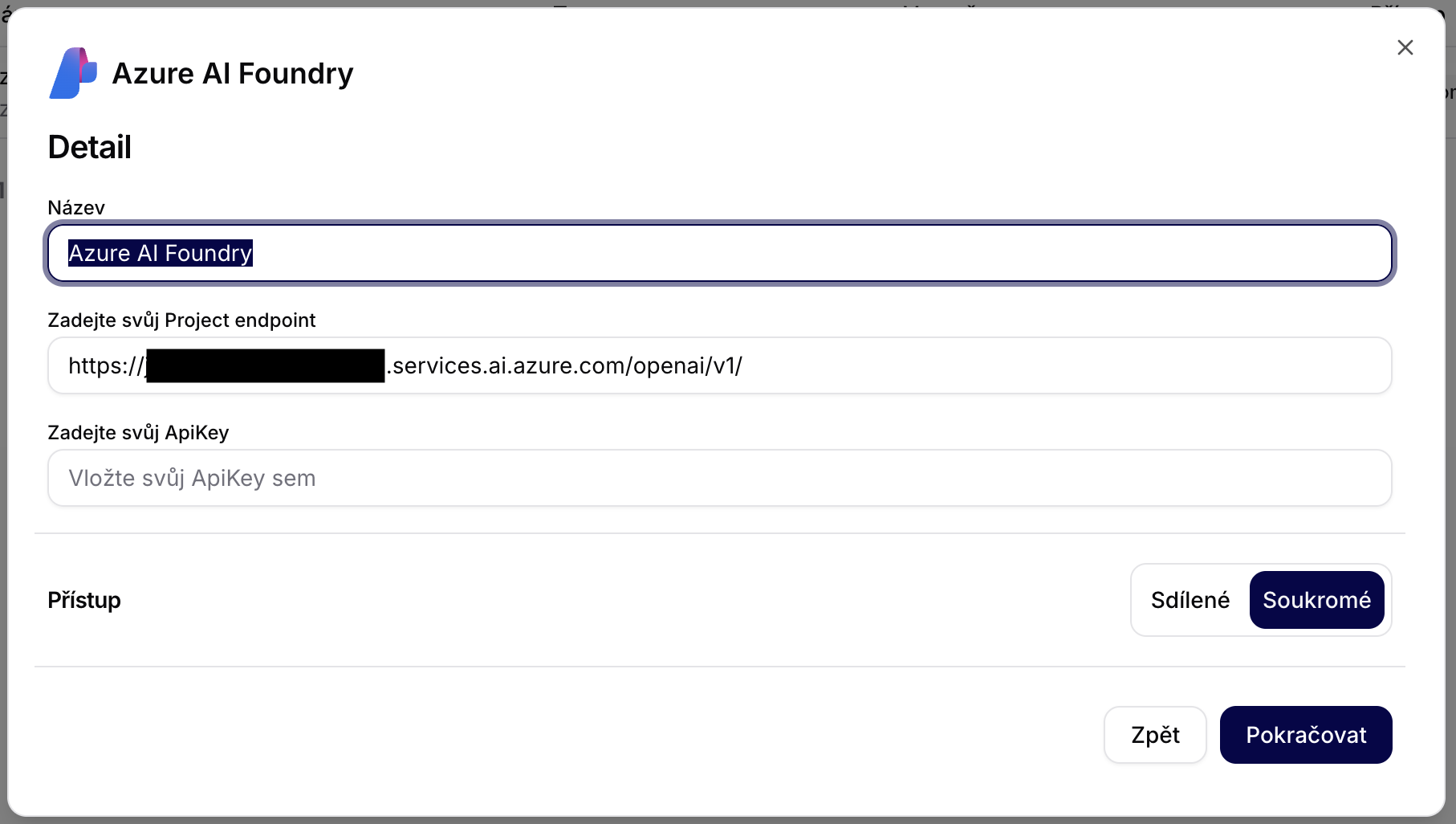

2) Remplissage des détails de l'intégration

Remplissez :

- Nom : par exemple,

Azure AI Foundry – PROD - Point de terminaison de projet (compatible OpenAI) :

https://<nom-de-ressource-foundry>.services.ai.azure.com/openai/v1/ - ApiKey : utilisez la clé API du projet (depuis ai.azure.com) ou la clé du Portail Azure.

- Accès : Privé (recommandé)

3) Vérification de l'intégration

Après avoir enregistré l'intégration :

- Siesta AI effectuera un test de validation.

- Le point de terminaison et la clé seront stockés de manière chiffrée.

- L'intégration est disponible pour les agents, workflows et collections de données.

Utilisation des modèles dans Siesta AI

- Ouvrez Agent / Modèle / Workflow.

- Sélectionnez Fournisseur de modèle : Azure AI Foundry.

- Choisissez nom de déploiement (par exemple,

gpt-5.2-chat). - Enregistrez la configuration.

Sécurité & Gouvernance

- Authentification via clé API.

- RBAC géré au niveau d'Azure.

- Possibilité de Point de terminaison privé + VNET.

- Journaux d'audit dans Azure Activity Log.

- Surveillance via Foundry + Azure Monitor.

Architecture recommandée

- Une ressource Foundry par environnement (DEV / STAGE / PROD).

- Plusieurs projets pour les équipes ou les clients.

- Déploiements de modèles séparés.

- Rotation des clés via Key Vault.

Augmentation de quota

Si vous avez besoin d'augmenter le quota d'Azure AI Foundry, utilisez ce document :

Liens utiles

- Portail Azure AI Foundry : https://ai.azure.com

- Documentation : https://learn.microsoft.com/azure/ai-studio/

- Catalogue de modèles : https://ai.azure.com/model-catalog

- Azure RBAC : https://learn.microsoft.com/azure/role-based-access-control/

Résumé

Azure AI Foundry fonctionne comme une infrastructure d'IA d'entreprise, tandis que Siesta AI construit des agents, des workflows, des collections de données et des intégrations avec des systèmes SaaS au-dessus. L'intégration est auditée et entièrement sous le contrôle du client dans Azure.