Azure AI Foundry

Azure AI Foundry ist eine Plattform in Azure zur Entwicklung, Bereitstellung und Verwaltung von KI-Anwendungen, Agenten und Modellen. Im Rahmen von Siesta AI dient sie als Enterprise-Backend für Inferenz und Agenten mit Unterstützung für RBAC, regionale Einschränkungen und Audits.

Übersicht

Siesta AI aus Azure AI Foundry:

- ruft bereitgestellte Modelle auf (Chat, Reasoning, Transcribe),

- verwendet einen OpenAI-kompatiblen Endpunkt für Inferenz,

- respektiert Azure RBAC und die Sicherheitsrichtlinien des Kunden.

Grundbegriffe

- Foundry-Ressource – Azure-Ressource vom Typ Azure AI Foundry in einem Abonnement und einer Ressourcengruppe.

- Foundry-Projekt – logisches Projekt innerhalb der Foundry-Ressource (Abteilung von Teams, Anwendungen und Umgebungen).

- Projektendpunkt – API-Endpunkt für projektbezogene Funktionen (Agenten, Bewertungen, Inferenz über die Foundry-API).

- Modellbereitstellung – spezifische Bereitstellung eines Modells (z.B.

gpt-5.2,gpt-5.2-chat). - API-Schlüssel – Schlüssel zur Authentifizierung von Aufrufen der Foundry-API.

Anforderungen

- Aktives Azure-Abonnement.

- Berechtigungen mindestens Mitwirkender für die Ziel-Ressourcengruppe.

- Registrierter Ressourcenanbieter Microsoft.Foundry.

- Zugriff auf ai.azure.com (Microsoft Entra ID).

Erstellung von Azure AI Foundry

1) Foundry-Ressource

- Melden Sie sich im Azure-Portal an.

- Erstellen Sie eine neue Ressource Azure AI Foundry.

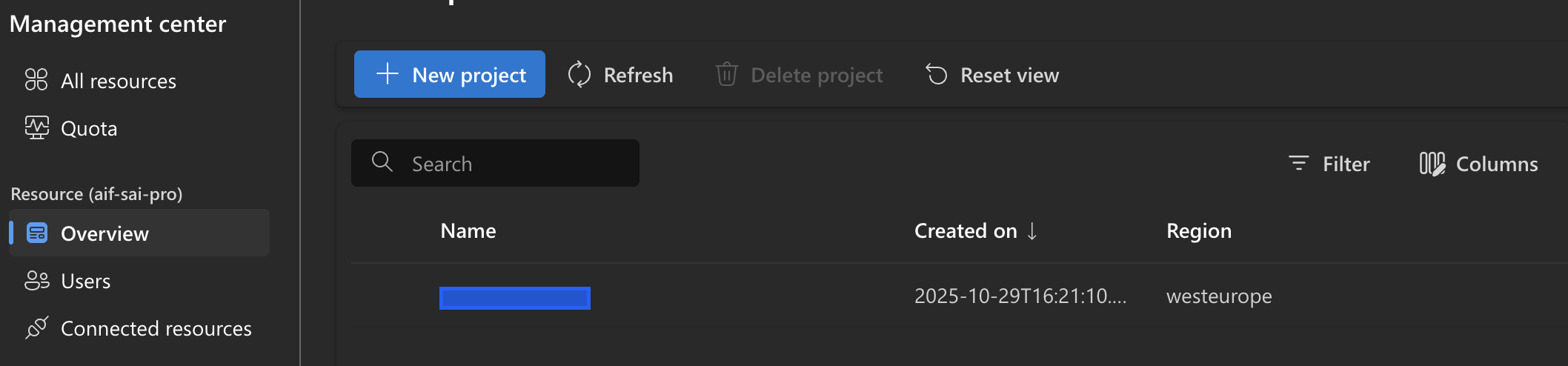

- Wählen Sie Abonnement, Ressourcengruppe, Region (z.B.

westeurope) und den Namen der Ressource (z.B.aif-sai-pro).

Die Foundry-Ressource dient als Container für alle Projekte.

2) Foundry-Projekt

- Öffnen Sie ai.azure.com.

- Wählen Sie links Management Center → Projekte.

- Klicken Sie auf Neues Projekt.

- Wählen Sie die vorhandene Foundry-Ressource aus und geben Sie den Projektnamen ein.

Bereitstellung von Modellen

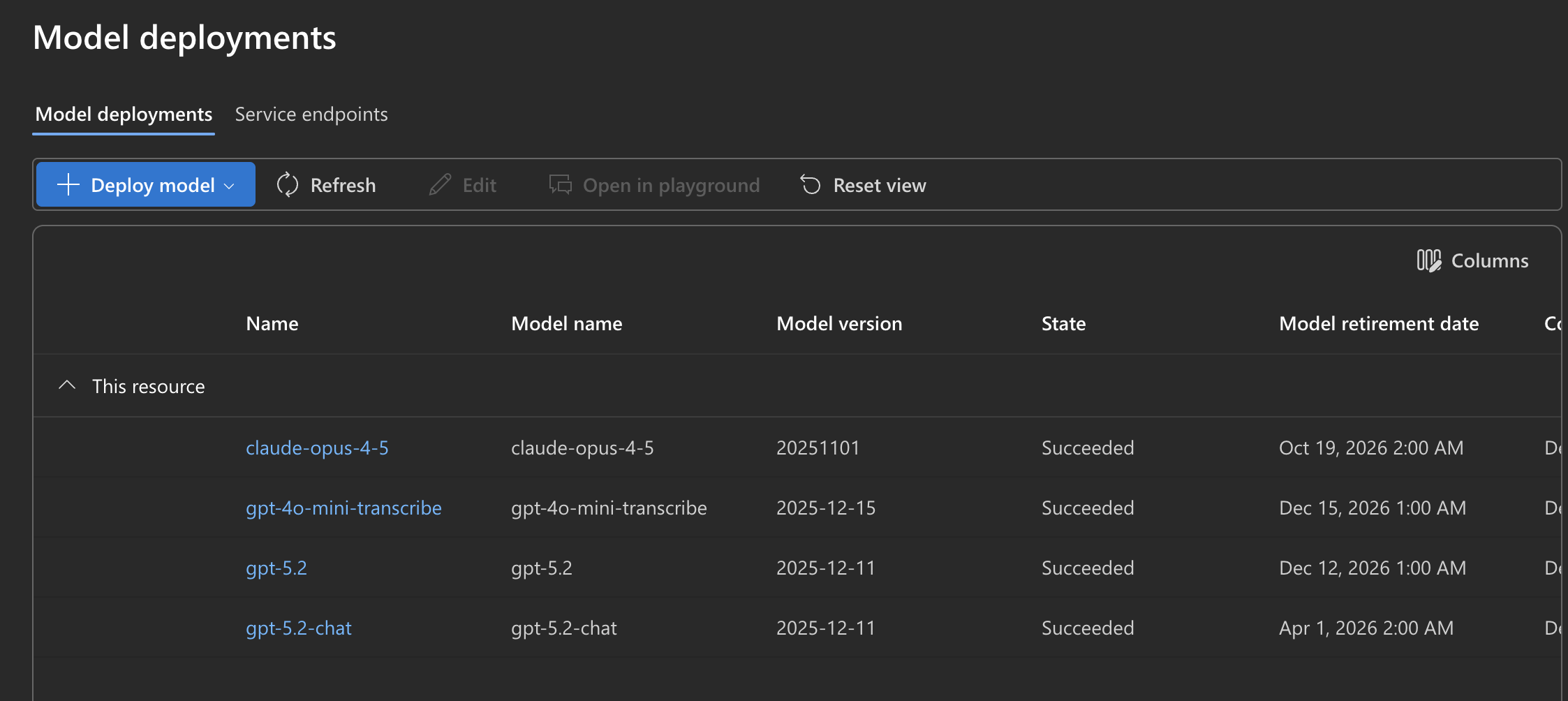

Modellbereitstellungen

Gehen Sie im Projekt zu Modellkatalog → Modellbereitstellungen und stellen Sie die verfügbaren Modelle bereit.

Beispiele für Bereitstellungen:

gpt-5.2gpt-5.2-chatgpt-4o-mini-transcribeclaude-opus-4-5

Jede Bereitstellung hat Bereitstellungsnamen, Modellversion, Status und Datum der Stilllegung.

⚠️ Siesta AI arbeitet mit Bereitstellungsnamen, nicht mit Modellnamen.

Endpunkte und API-Schlüssel

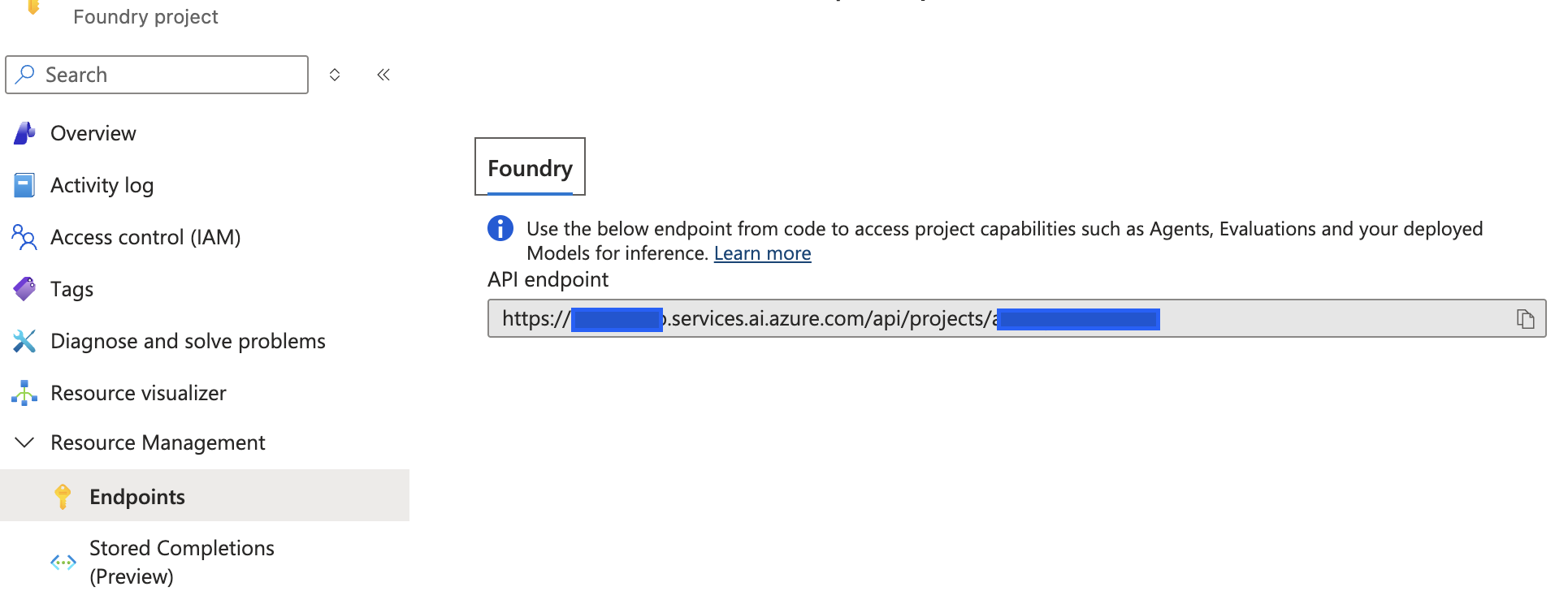

Projektendpunkt (Foundry-API)

Der Projektendpunkt dient für projektbezogene Funktionen (Agenten, Bewertungen und Foundry-Inferenz-API). Sie finden ihn in den Projektdetails.

Form des Endpunkts:

https://<foundry-resource-name>.services.ai.azure.com/api/projects/<project-id-or-name>

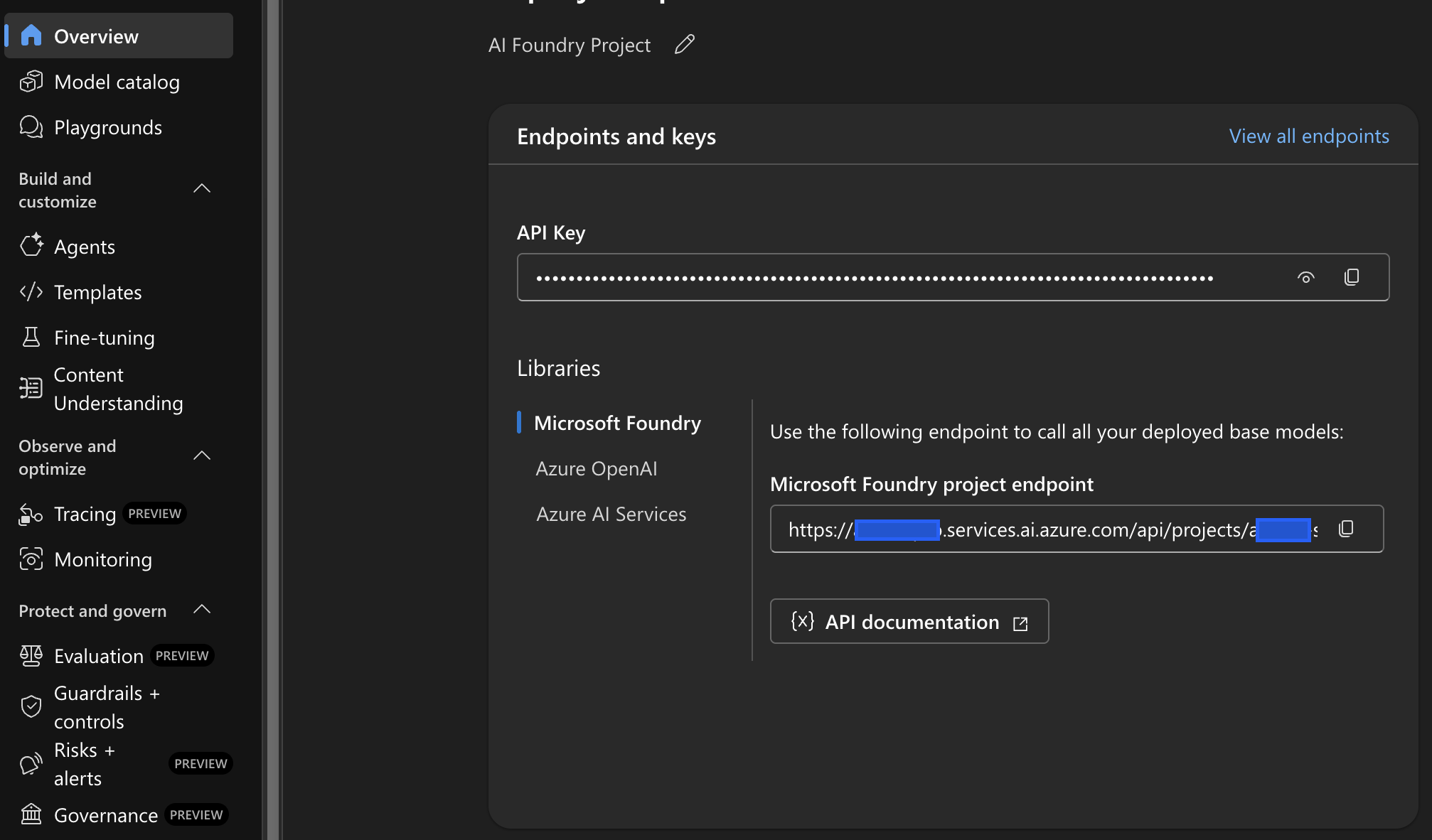

Endpunkte und Schlüssel im Projekt

Öffnen Sie in ai.azure.com das Projekt und den Abschnitt Endpunkte und Schlüssel:

- Microsoft Foundry-Projektendpunkt

- API-Schlüssel für das Projekt

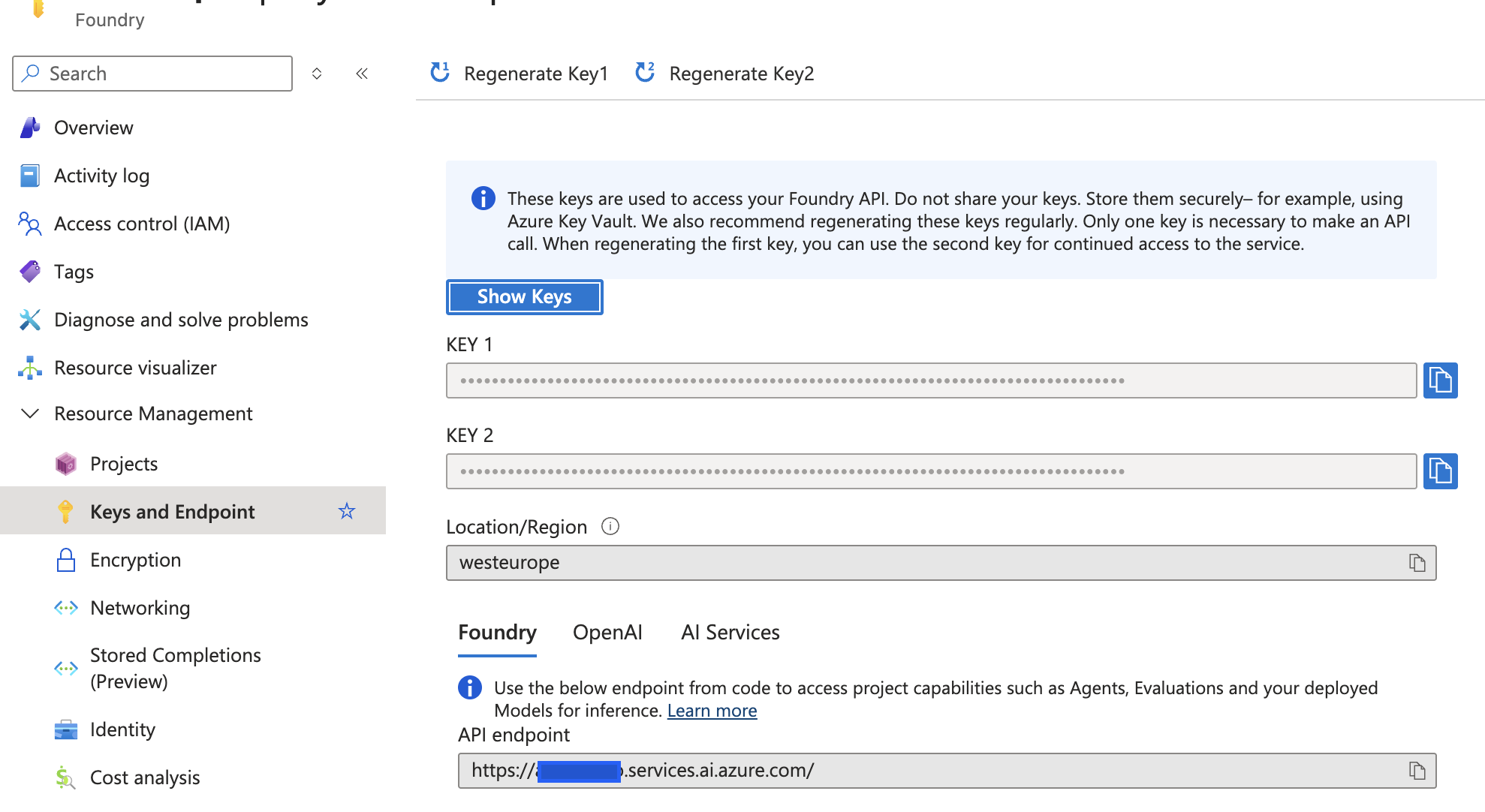

Schlüssel und Endpunkt (Azure-Portal)

Im Azure-Portal auf der Foundry-Ressource:

- Schlüssel und Endpunkt → Foundry

- Schlüssel 1 / Schlüssel 2 zur Rotation

- Basisendpunkt der Ressource

Anbindung von Azure AI Foundry an Siesta AI

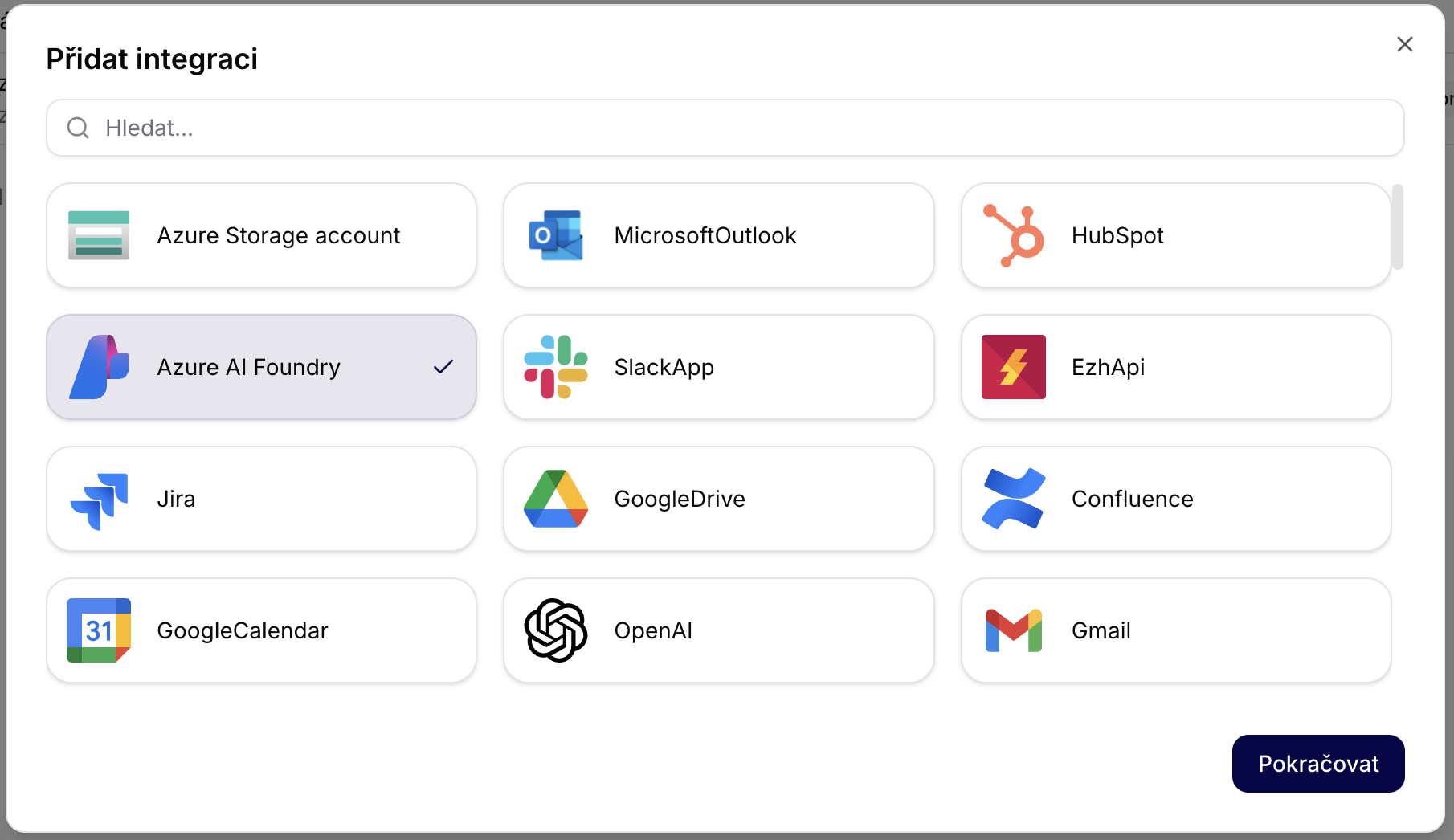

1) Hinzufügen einer Integration

- Melden Sie sich bei Siesta AI Admin an.

- Öffnen Sie Integrationen.

- Klicken Sie auf Integration hinzufügen.

- Wählen Sie Azure AI Foundry.

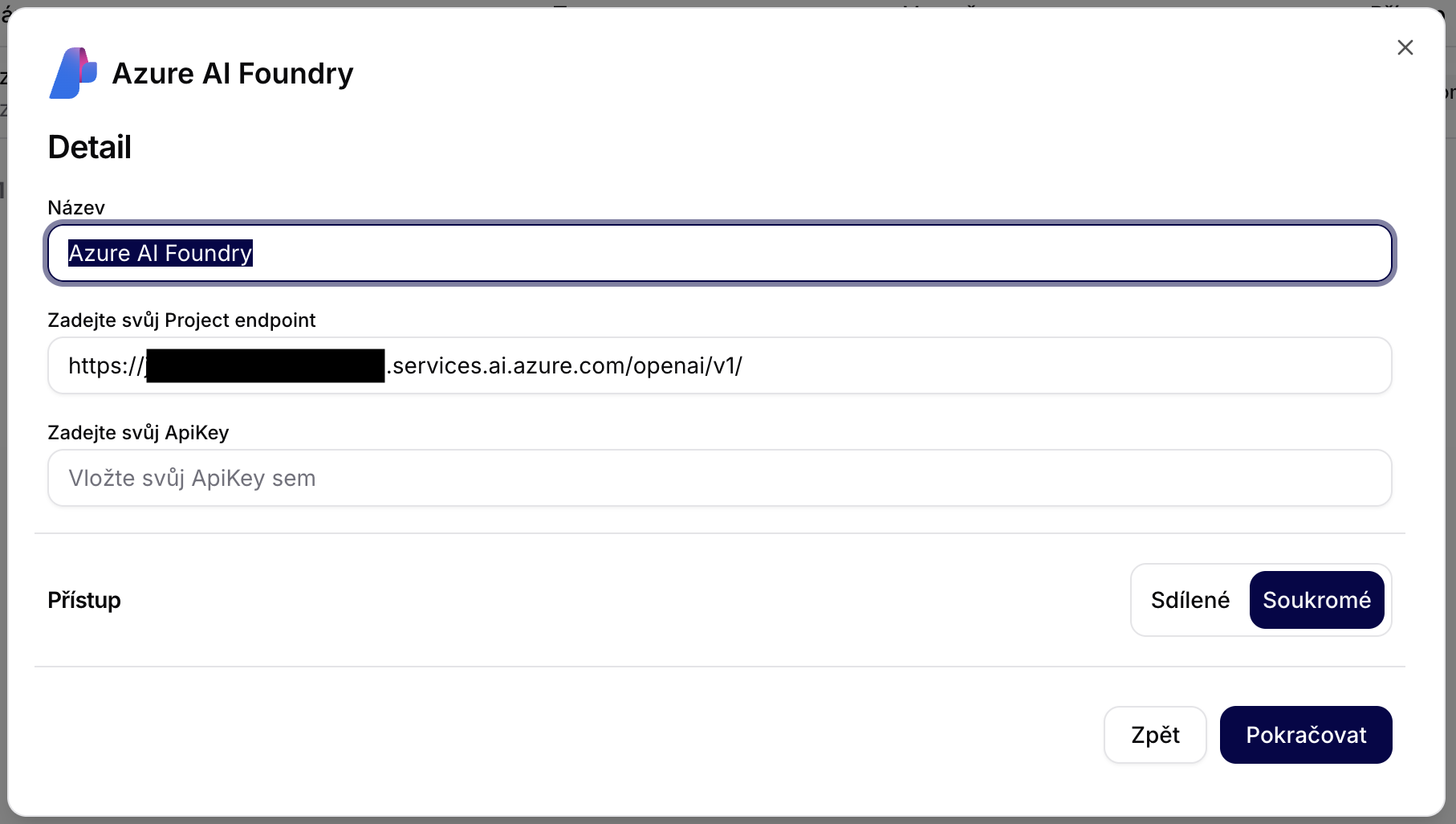

2) Ausfüllen der Integrationsdetails

Füllen Sie aus:

- Name: z.B.

Azure AI Foundry – PROD - Projektendpunkt (OpenAI-kompatibel):

https://<foundry-resource-name>.services.ai.azure.com/openai/v1/ - ApiKey: Verwenden Sie den API-Schlüssel des Projekts (von ai.azure.com) oder den Schlüssel aus dem Azure-Portal.

- Zugriff: Privat (empfohlen)

3) Überprüfung der Integration

Nach dem Speichern der Integration:

- Führt Siesta AI einen Validierungstest durch.

- Der Endpunkt und der Schlüssel werden verschlüsselt gespeichert.

- Die Integration ist verfügbar für Assistenten, Workflows und Datensammlungen.

Verwendung von Modellen in Siesta AI

- Öffnen Sie Assistent / Vorlage / Workflow.

- Wählen Sie Modellanbieter: Azure AI Foundry.

- Wählen Sie Bereitstellungsnamen (z.B.

gpt-5.2-chat). - Speichern Sie die Konfiguration.

Sicherheit & Governance

- Authentifizierung über API-Schlüssel.

- RBAC wird auf Azure-Ebene gesteuert.

- Möglichkeit für Private Endpoint + VNET.

- Audit-Logs im Azure Activity Log.

- Monitoring über Foundry + Azure Monitor.

Empfohlene Architektur

- Eine Foundry-Ressource pro Umgebung (DEV / STAGE / PROD).

- Mehrere Projekte für Teams oder Kunden.

- Getrennte Modellbereitstellungen.

- Schlüsselrotation über Key Vault.

Erhöhung des Kontingents

Wenn Sie das Kontingent von Azure AI Foundry erhöhen müssen, verwenden Sie dieses Dokument:

Nützliche Links

- Azure AI Foundry-Portal: https://ai.azure.com

- Dokumentation: https://learn.microsoft.com/azure/ai-studio/

- Modellkatalog: https://ai.azure.com/model-catalog

- Azure RBAC: https://learn.microsoft.com/azure/role-based-access-control/

Zusammenfassung

Azure AI Foundry fungiert als Enterprise-KI-Rückgrat, während Siesta AI darauf Assistenten, Workflows, Datensammlungen und Integrationen mit SaaS-Systemen aufbaut. Die Integration ist auditierbar und vollständig unter Kontrolle des Kunden in Azure.