Azure AI Foundry

Azure AI Foundry es una plataforma en Azure para el desarrollo, implementación y gestión de aplicaciones, agentes y modelos de IA. En el marco de Siesta AI, sirve como backend empresarial para inferencias y agentes con soporte para RBAC, restricciones regionales y auditorías.

Resumen

Siesta AI de Azure AI Foundry:

- llama a modelos implementados (chat, razonamiento, transcripción),

- utiliza un endpoint compatible con OpenAI para inferencias,

- respeta las políticas de seguridad y RBAC de Azure del cliente.

Términos básicos

- Foundry resource – recurso de Azure del tipo Azure AI Foundry en la suscripción y grupo de recursos.

- Foundry project – proyecto lógico dentro del recurso Foundry (separación de equipos, aplicaciones y entornos).

- Project endpoint – endpoint API para las capacidades del proyecto (agentes, evaluaciones, inferencias a través de la API de Foundry).

- Model deployment – implementación específica de un modelo (por ejemplo,

gpt-5.2,gpt-5.2-chat). - API key – clave para la autenticación de llamadas a la API de Foundry.

Requisitos

- Suscripción activa de Azure.

- Permisos de al menos Contributor en el grupo de recursos de destino.

- Proveedor de recursos registrado Microsoft.Foundry.

- Acceso a ai.azure.com (Microsoft Entra ID).

Creación de Azure AI Foundry

1) Foundry resource

- Inicie sesión en Azure Portal.

- Cree un nuevo recurso Azure AI Foundry.

- Seleccione Subscription, Resource Group, Region (por ejemplo,

westeurope) y el nombre del recurso (por ejemplo,aif-sai-pro).

El recurso Foundry sirve como contenedor para todos los proyectos.

2) Foundry project

- Abra ai.azure.com.

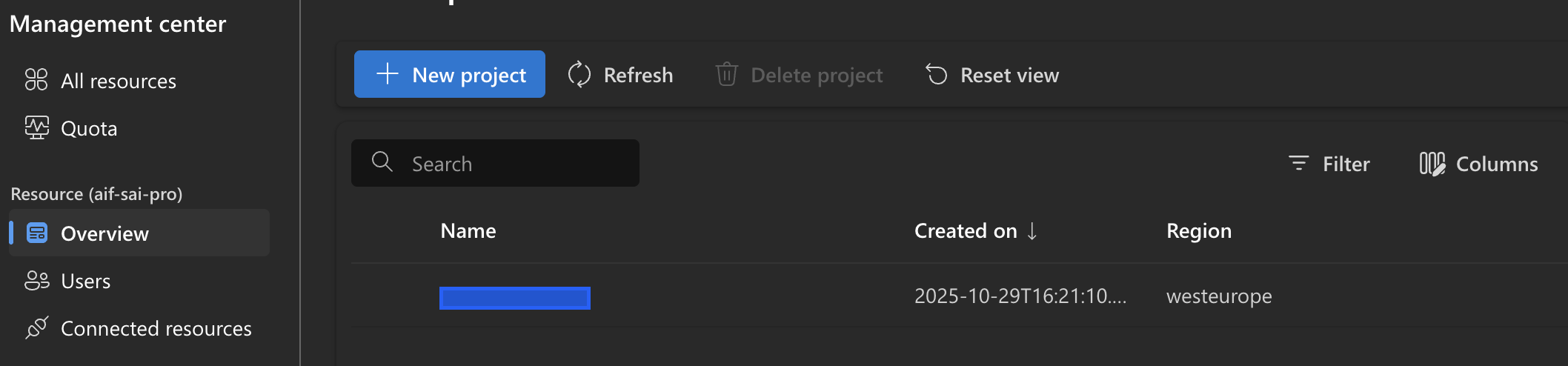

- A la izquierda, seleccione Management Center → Projects.

- Haga clic en New project.

- Seleccione el recurso Foundry existente e ingrese el nombre del proyecto.

Implementación de modelos

Model deployments

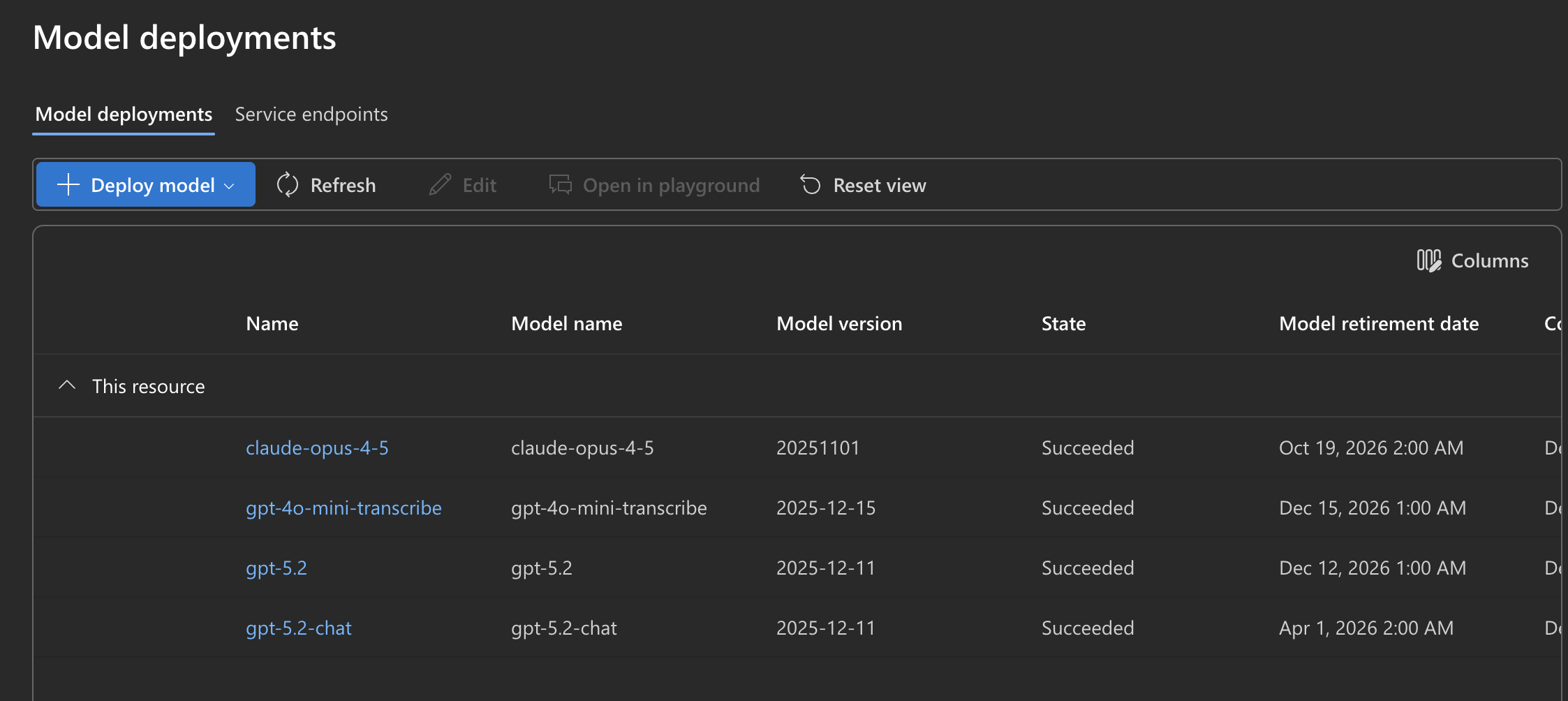

En el proyecto, vaya a Model catalog → Model deployments y despliegue los modelos disponibles.

Ejemplos de implementaciones:

gpt-5.2gpt-5.2-chatgpt-4o-mini-transcribeclaude-opus-4-5

Cada implementación tiene un nombre de implementación, versión del modelo, estado y fecha de retiro.

⚠️ Siesta AI trabaja con el nombre de implementación, no con el nombre del modelo.

Endpoints y claves API

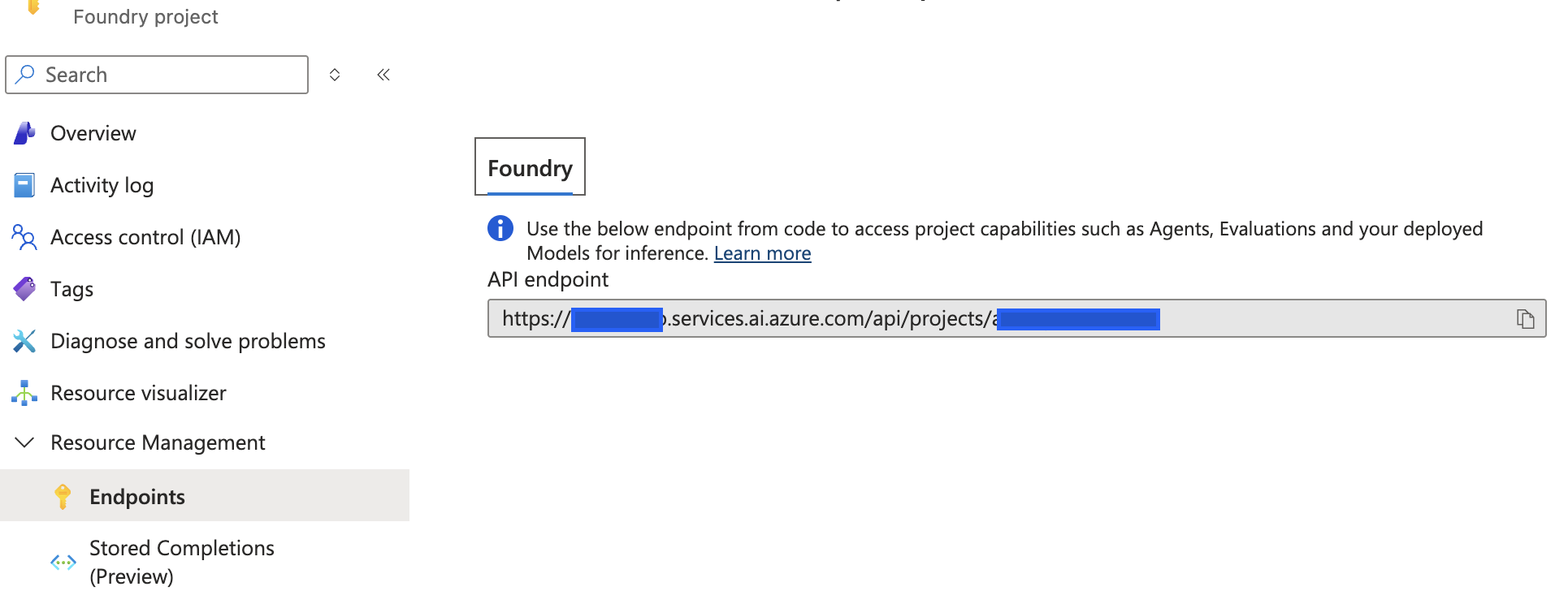

Project endpoint (Foundry API)

El endpoint del proyecto se utiliza para las capacidades del proyecto (agentes, evaluaciones y API de inferencia de Foundry). Lo encontrará en los detalles del proyecto.

Formato del endpoint:

https://<foundry-resource-name>.services.ai.azure.com/api/projects/<project-id-or-name>

Endpoints y claves en el proyecto

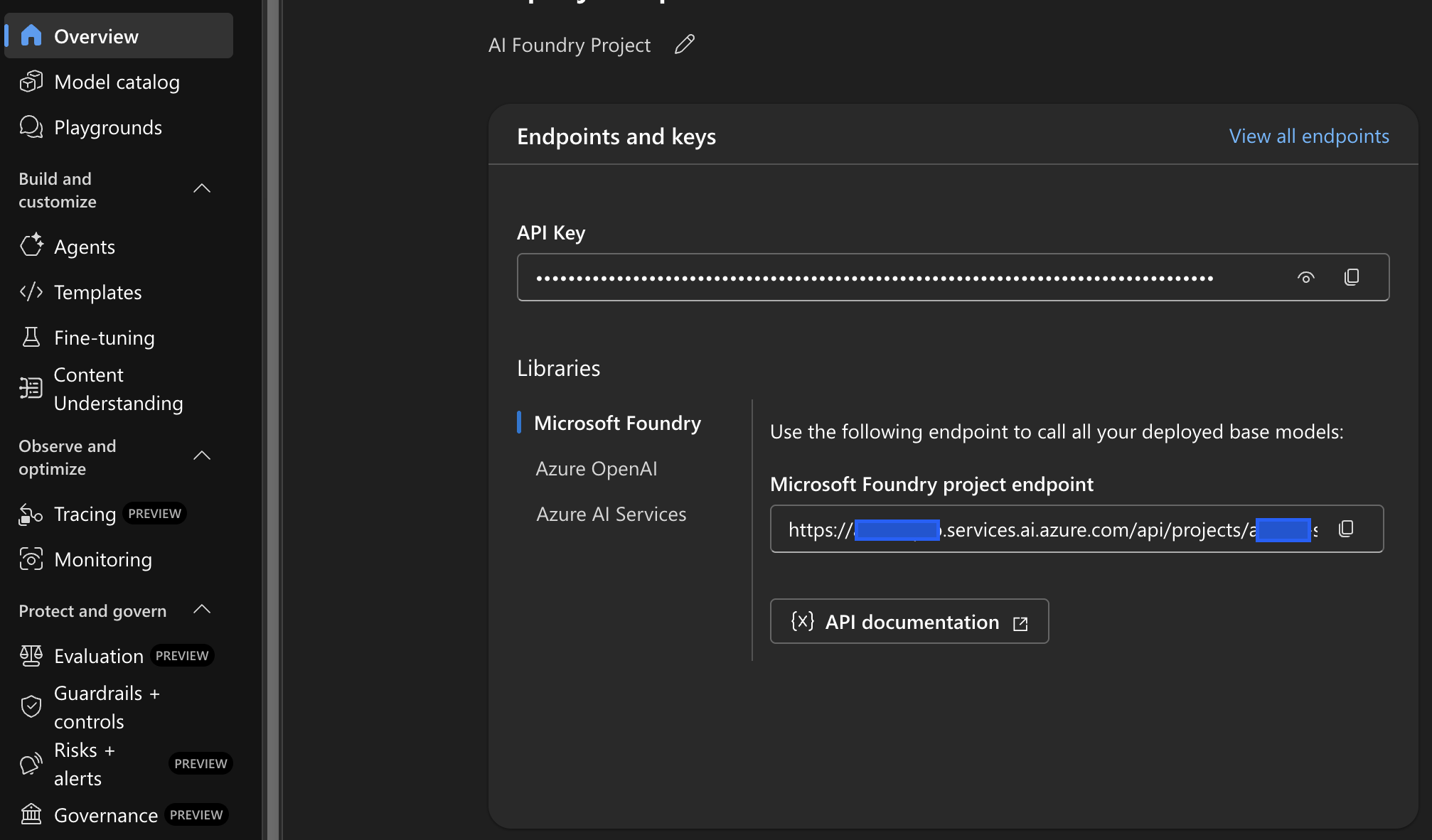

En ai.azure.com, abra el proyecto y la sección Endpoints and keys:

- Microsoft Foundry project endpoint

- API Key para el proyecto

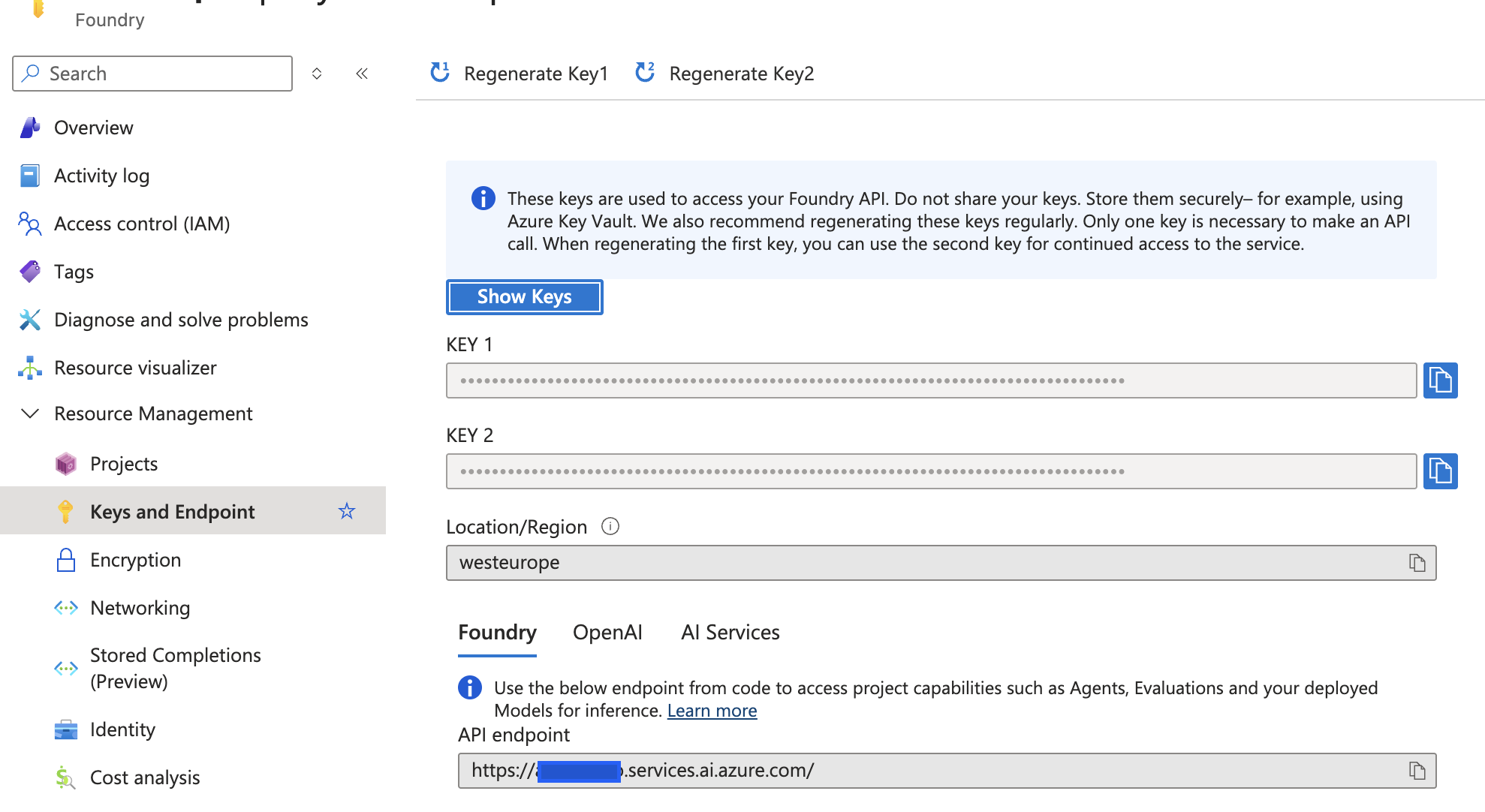

Claves y Endpoint (Azure Portal)

En Azure Portal en el recurso Foundry:

- Keys and Endpoint → Foundry

- Key 1 / Key 2 para rotación

- Endpoint base del recurso

Conexión de Azure AI Foundry a Siesta AI

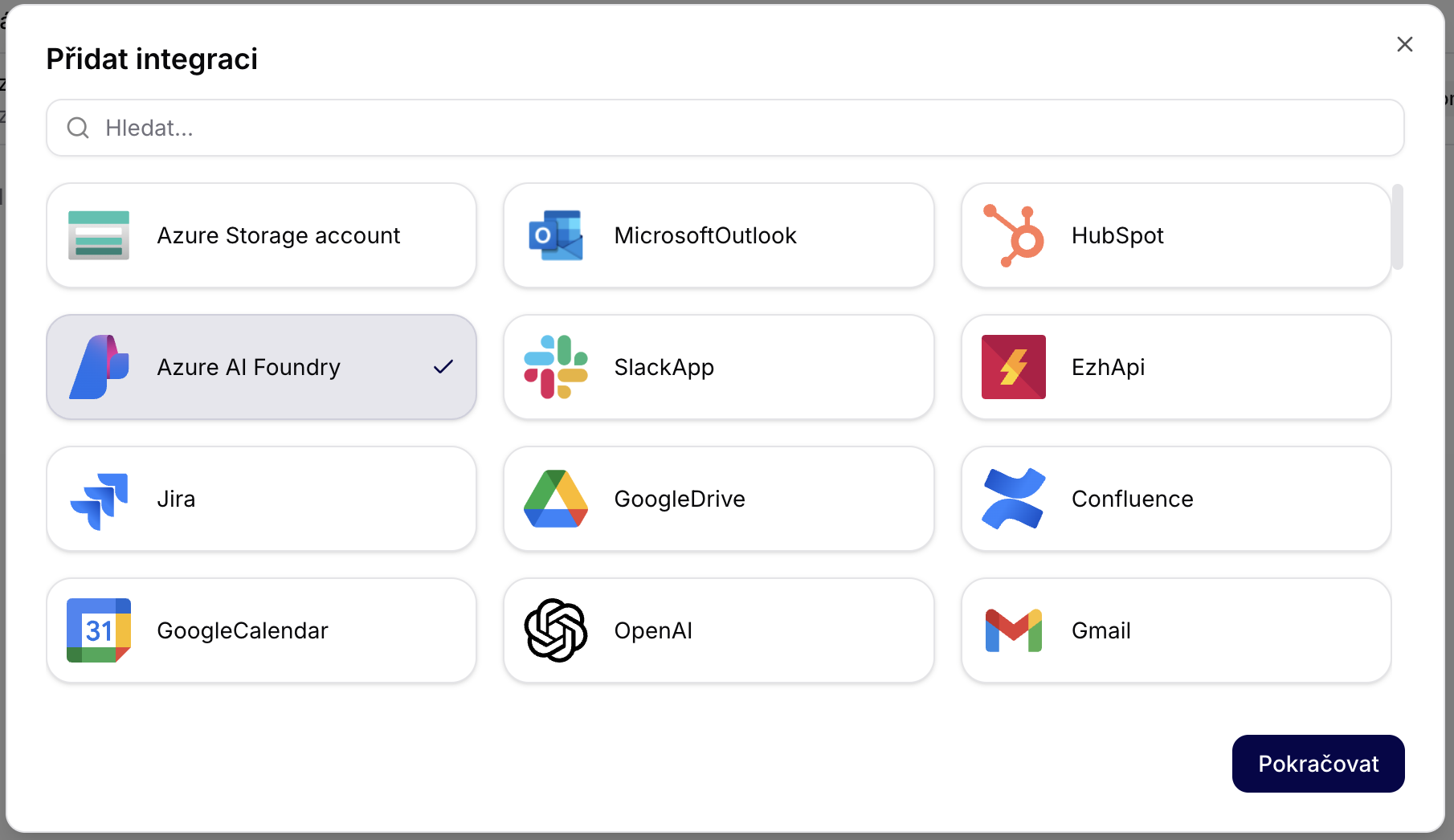

1) Agregar integración

- Inicie sesión en Siesta AI Admin.

- Abra Integrations.

- Haga clic en Agregar integración.

- Seleccione Azure AI Foundry.

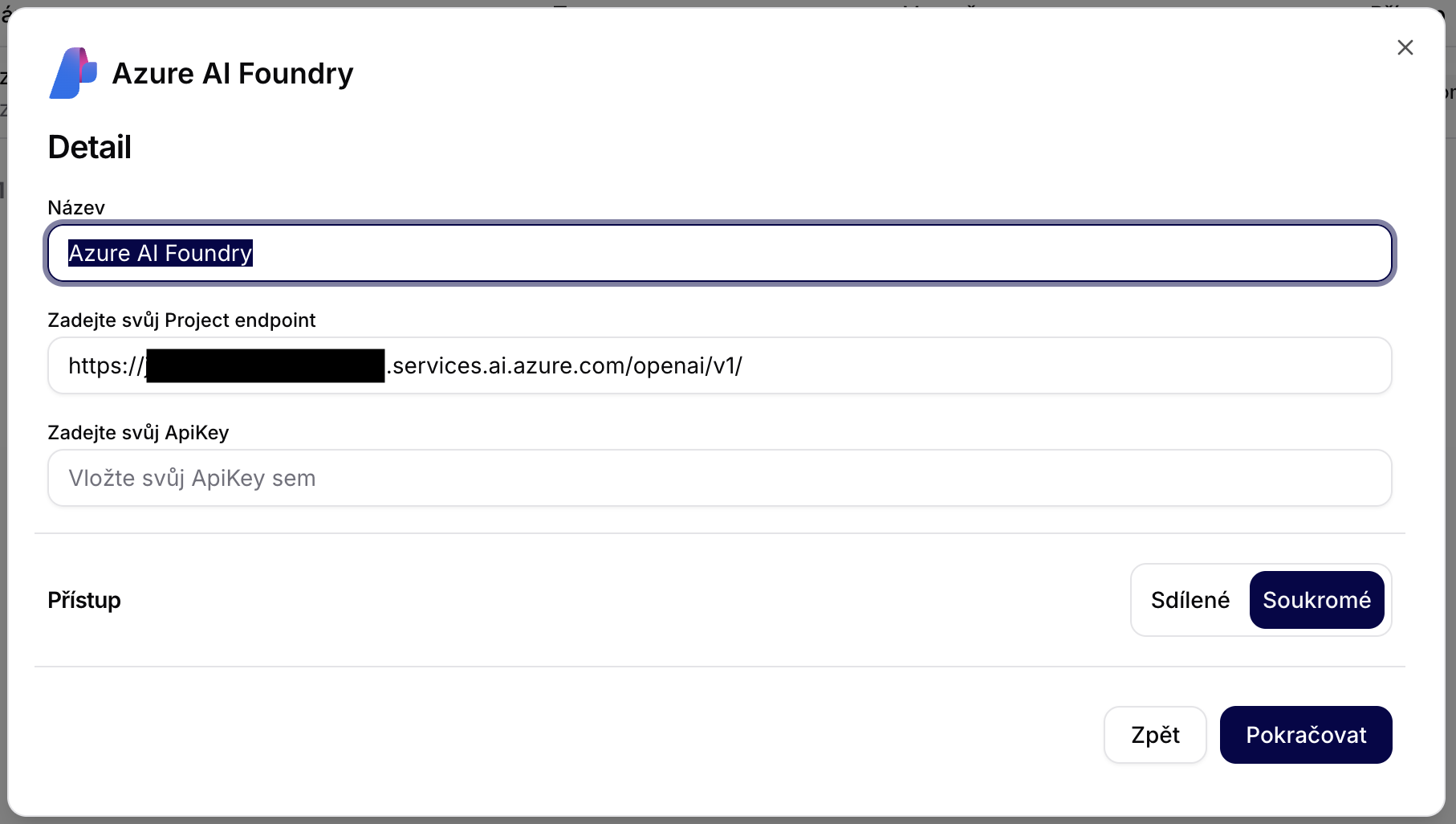

2) Rellenar detalles de la integración

Complete:

- Nombre: por ejemplo,

Azure AI Foundry – PROD - Project endpoint (compatible con OpenAI):

https://<foundry-resource-name>.services.ai.azure.com/openai/v1/ - ApiKey: use la API key del proyecto (de ai.azure.com) o la clave del Azure Portal.

- Acceso: Privado (recomendado)

3) Verificación de la integración

Después de guardar la integración:

- Siesta AI realizará una prueba de validación.

- El endpoint y la clave se guardarán de forma cifrada.

- La integración estará disponible para asistentes, workflows y colecciones de datos.

Uso de modelos en Siesta AI

- Abra Agent / Template / Workflow.

- Seleccione Model provider: Azure AI Foundry.

- Elija deployment name (por ejemplo,

gpt-5.2-chat). - Guarde la configuración.

Seguridad y Gobernanza

- Autenticación a través de la clave API.

- RBAC gestionado a nivel de Azure.

- Opción de Private Endpoint + VNET.

- Registros de auditoría en Azure Activity Log.

- Monitoreo a través de Foundry + Azure Monitor.

Arquitectura recomendada

- Un recurso Foundry por entorno (DEV / STAGE / PROD).

- Varios proyectos para equipos o clientes.

- Implementaciones de modelos separadas.

- Rotación de claves a través de Key Vault.

Aumento de cuota

Si necesita aumentar la cuota de Azure AI Foundry, utilice este documento:

Enlaces útiles

- Portal de Azure AI Foundry: https://ai.azure.com

- Documentación: https://learn.microsoft.com/azure/ai-studio/

- Catálogo de modelos: https://ai.azure.com/model-catalog

- Azure RBAC: https://learn.microsoft.com/azure/role-based-access-control/

Resumen

Azure AI Foundry funciona como la columna vertebral empresarial de IA, mientras que Siesta AI construye sobre ella asistentes, flujos de trabajo, colecciones de datos e integraciones con sistemas SaaS. La integración es auditada y está completamente bajo el control del cliente en Azure.