Azure AI Foundry

Azure AI Foundry è una piattaforma in Azure per lo sviluppo, il deployment e la gestione di applicazioni, agenti e modelli AI. All'interno di Siesta AI funge da backend enterprise per l'inferenza e gli agenti con supporto RBAC, restrizioni regionali e audit.

Panoramica

Siesta AI da Azure AI Foundry:

- chiama modelli distribuiti (chat, reasoning, trascrizione),

- utilizza un endpoint compatibile con OpenAI per l'inferenza,

- rispetta le politiche di sicurezza e RBAC di Azure del cliente.

Concetti di base

- Foundry resource – risorsa Azure di tipo Azure AI Foundry in subscription e resource group.

- Foundry project – progetto logico all'interno della Foundry resource (separazione di team, applicazioni e ambienti).

- Project endpoint – API endpoint per le capacità del progetto (agenti, valutazioni, inferenza tramite Foundry API).

- Model deployment – specifico deployment di un modello (es.

gpt-5.2,gpt-5.2-chat). - API key – chiave per l'autenticazione delle chiamate all'API di Foundry.

Requisiti

- Subscription Azure attiva.

- Permessi almeno di Contributor sul resource group di destinazione.

- Provider di risorse registrato Microsoft.Foundry.

- Accesso a ai.azure.com (Microsoft Entra ID).

Creazione di Azure AI Foundry

1) Foundry resource

- Accedi al Azure Portal.

- Crea una nuova risorsa Azure AI Foundry.

- Seleziona Subscription, Resource Group, Region (es.

westeurope) e il nome della risorsa (es.aif-sai-pro).

La Foundry resource funge da contenitore per tutti i progetti.

2) Foundry project

- Apri ai.azure.com.

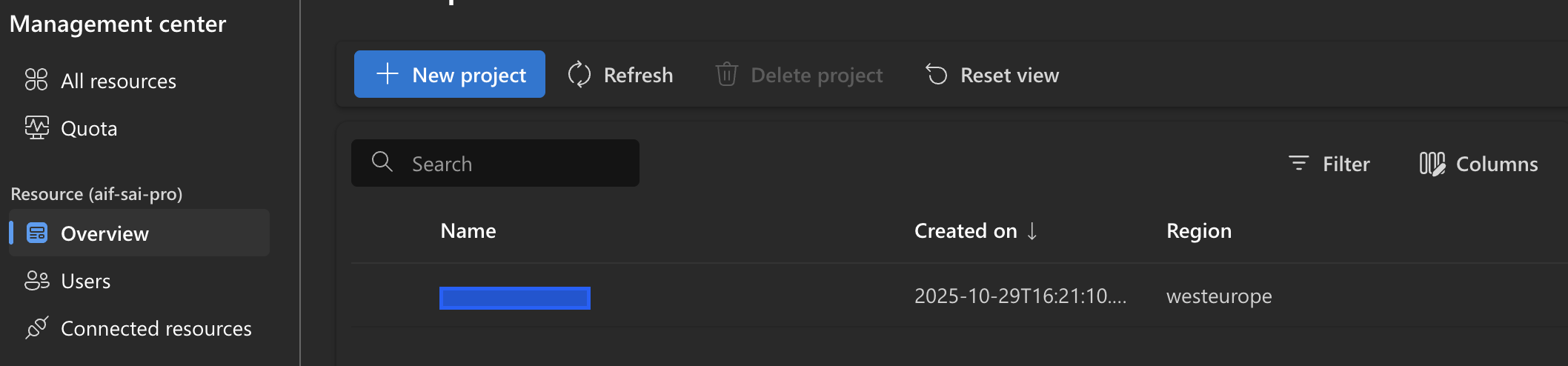

- A sinistra seleziona Management Center → Projects.

- Clicca su New project.

- Seleziona la Foundry resource esistente e inserisci il nome del progetto.

Deployment dei modelli

Model deployments

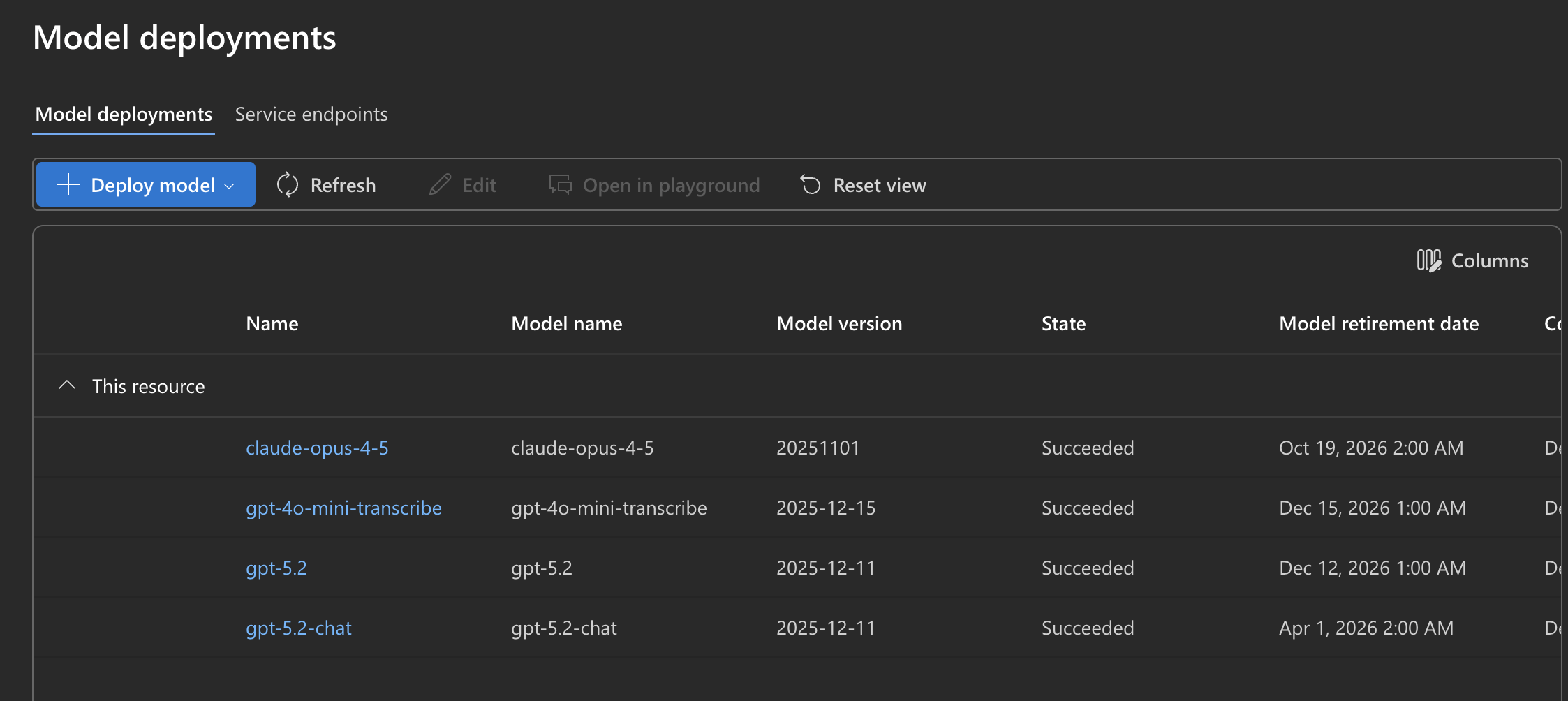

Nel progetto vai su Model catalog → Model deployments e distribuisci i modelli disponibili.

Esempi di deployment:

gpt-5.2gpt-5.2-chatgpt-4o-mini-transcribeclaude-opus-4-5

Ogni deployment ha nome del deployment, versione del modello, stato e data di retirement.

⚠️ Siesta AI lavora con nome del deployment, non con il nome del modello.

Endpoint e chiavi API

Project endpoint (Foundry API)

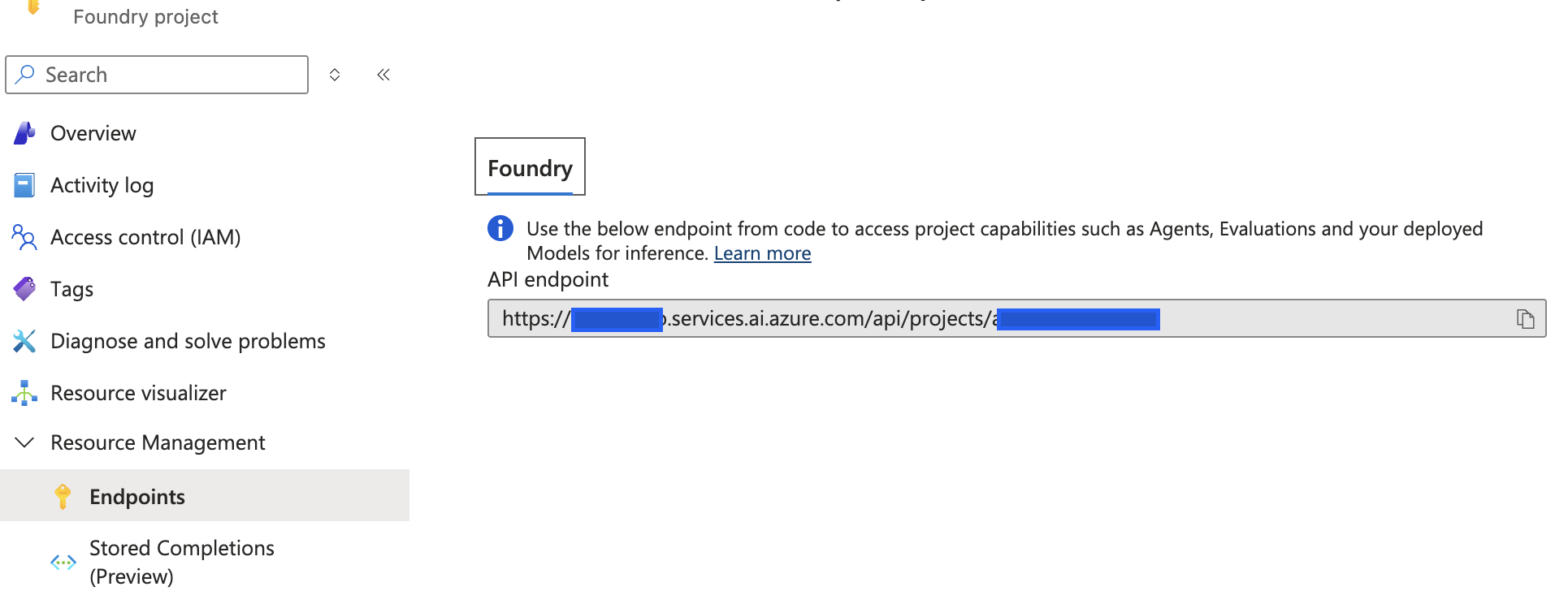

Il project endpoint serve per le capacità del progetto (agenti, valutazioni e API di inferenza di Foundry). Lo trovi nei dettagli del progetto.

Forma dell'endpoint:

https://<foundry-resource-name>.services.ai.azure.com/api/projects/<project-id-or-name>

Endpoints e chiavi nel progetto

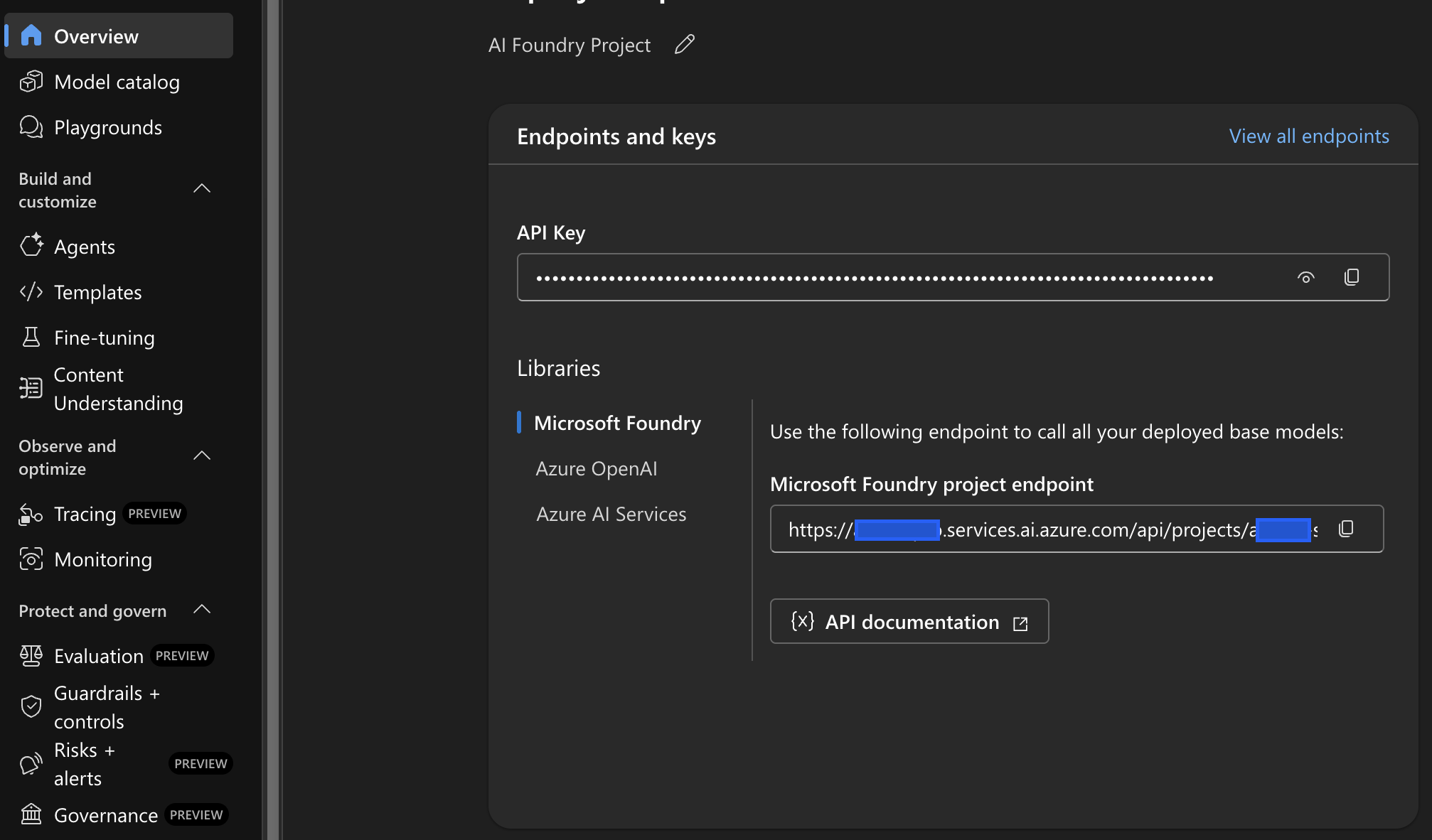

In ai.azure.com apri il progetto e la sezione Endpoints and keys:

- Microsoft Foundry project endpoint

- API Key per il progetto

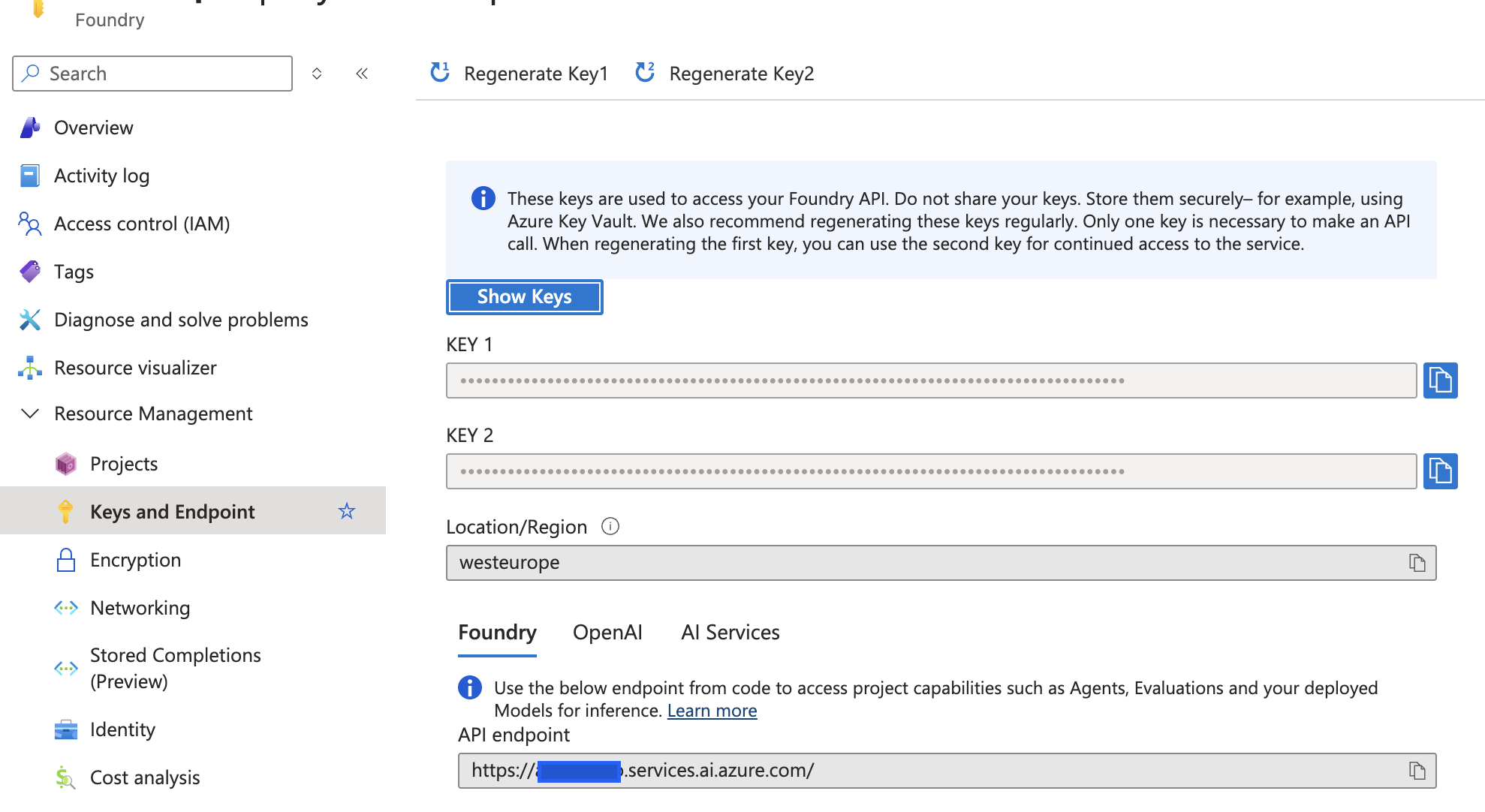

Keys and Endpoint (Azure Portal)

Nel Azure Portal sulla Foundry resource:

- Keys and Endpoint → Foundry

- Key 1 / Key 2 per la rotazione

- Endpoint di base della risorsa

Integrazione di Azure AI Foundry in Siesta AI

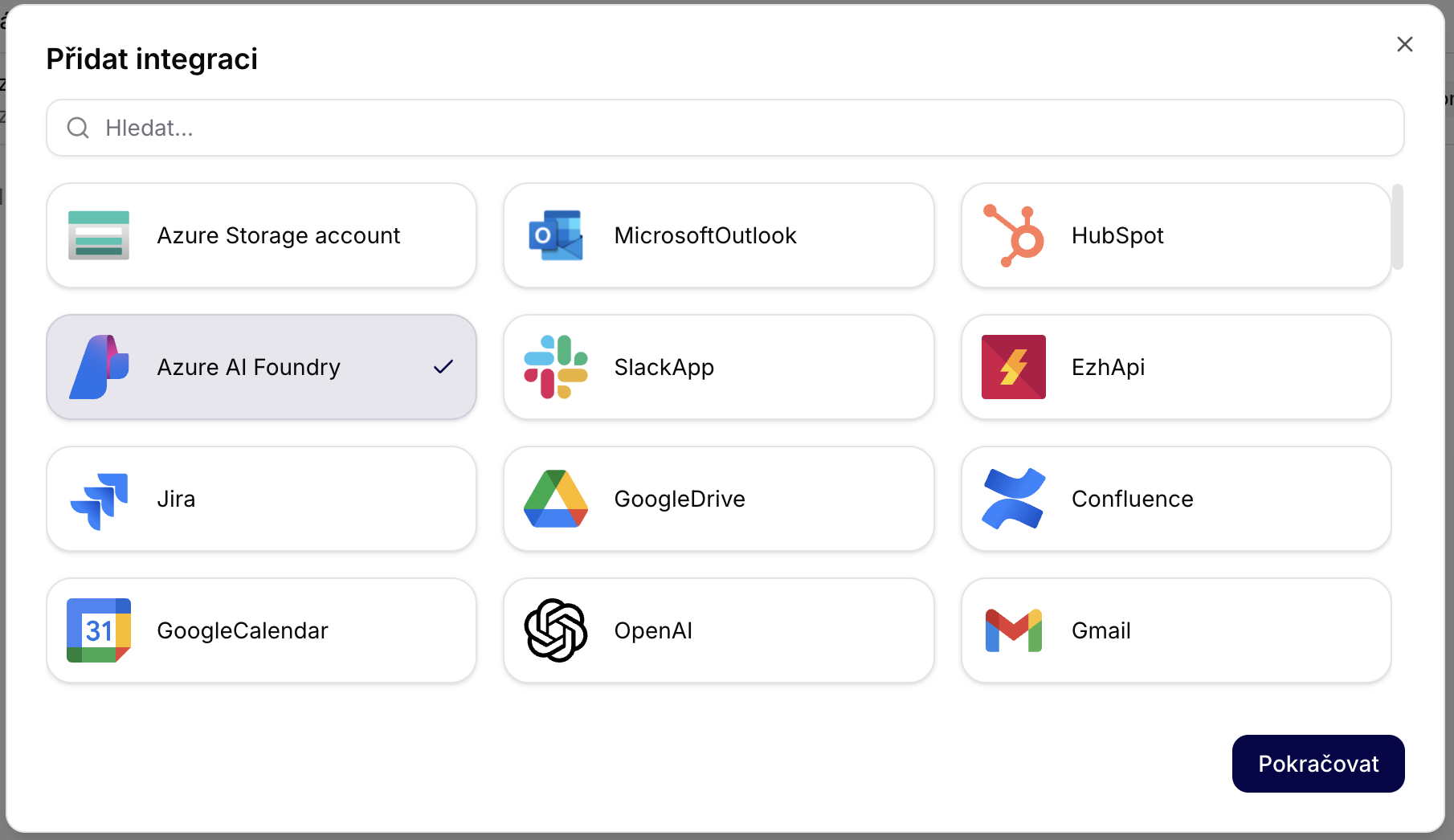

1) Aggiunta dell'integrazione

- Accedi a Siesta AI Admin.

- Apri Integrations.

- Clicca su Aggiungi integrazione.

- Seleziona Azure AI Foundry.

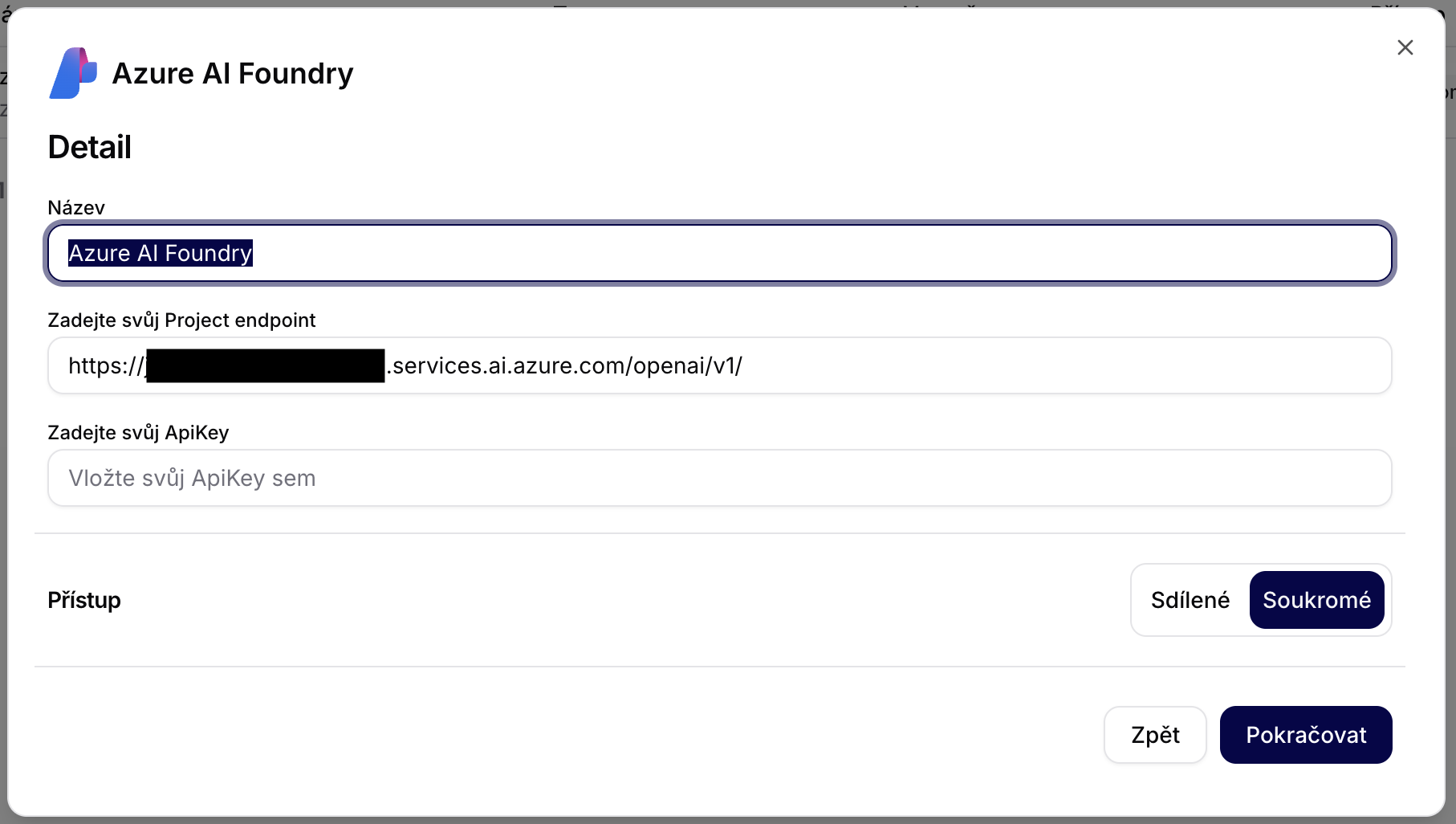

2) Compilazione dei dettagli dell'integrazione

Compila:

- Nome: es.

Azure AI Foundry – PROD - Project endpoint (OpenAI‑compatible):

https://<foundry-resource-name>.services.ai.azure.com/openai/v1/ - ApiKey: utilizza API key del progetto (da ai.azure.com) o chiave dal Azure Portal.

- Accesso: Privato (consigliato)

3) Verifica dell'integrazione

Dopo aver salvato l'integrazione:

- Siesta AI eseguirà un test di validazione.

- L'endpoint e la chiave verranno salvati in modo crittografato.

- L'integrazione sarà disponibile per assistenti, workflow e data collections.

Utilizzo dei modelli in Siesta AI

- Apri Agent / Template / Workflow.

- Seleziona Model provider: Azure AI Foundry.

- Scegli nome del deployment (es.

gpt-5.2-chat). - Salva la configurazione.

Sicurezza e Governance

- Autenticazione tramite chiave API.

- RBAC gestito a livello di Azure.

- Possibilità di Private Endpoint + VNET.

- Log di audit in Azure Activity Log.

- Monitoraggio tramite Foundry + Azure Monitor.

Architettura consigliata

- Una Foundry resource per ambiente (DEV / STAGE / PROD).

- Più progetti per team o clienti.

- Deployment di modelli separati.

- Rotazione delle chiavi tramite Key Vault.

Aumento della quota

Se hai bisogno di aumentare la quota di Azure AI Foundry, utilizza questo documento:

Link utili

- Portale Azure AI Foundry: https://ai.azure.com

- Documentazione: https://learn.microsoft.com/azure/ai-studio/

- Catalogo modelli: https://ai.azure.com/model-catalog

- Azure RBAC: https://learn.microsoft.com/azure/role-based-access-control/

Riepilogo

Azure AI Foundry funge da backbone AI enterprise, mentre Siesta AI costruisce assistenti, workflow, raccolte di dati e integrazioni con sistemi SaaS sopra di esso. L'integrazione è auditabile e completamente sotto il controllo del cliente in Azure.