Azure AI Foundry

Azure AI Foundry er en plattform i Azure for utvikling, distribusjon og administrasjon av AI-applikasjoner, agenter og modeller. I Siesta AI fungerer den som en enterprise backend for inferens og agenter med støtte for RBAC, regionale begrensninger og revisjoner.

Oversikt

Siesta AI fra Azure AI Foundry:

- kaller distribuerte modeller (chat, reasoning, transcribe),

- bruker OpenAI-kompatibel endpoint for inferens,

- respekterer Azure RBAC og kundens sikkerhetspolicyer.

Grunnleggende begreper

- Foundry resource – Azure resource av typen Azure AI Foundry i abonnementet og ressursgruppen.

- Foundry project – et logisk prosjekt innenfor Foundry resource (separasjon av team, applikasjoner og miljøer).

- Project endpoint – API endpoint for prosjektets kapabiliteter (agenter, evalueringer, inferens via Foundry API).

- Model deployment – spesifikk distribusjon av en modell (f.eks.

gpt-5.2,gpt-5.2-chat). - API key – nøkkel for autentisering av kall til Foundry API.

Krav

- Aktiv Azure-abonnement.

- Rettigheter minst Contributor på målressursgruppen.

- Registrert ressursleverandør Microsoft.Foundry.

- Tilgang til ai.azure.com (Microsoft Entra ID).

Oppretting av Azure AI Foundry

1) Foundry resource

- Logg inn på Azure Portal.

- Opprett en ny ressurs Azure AI Foundry.

- Velg Subscription, Resource Group, Region (f.eks.

westeurope) og navnet på ressursen (f.eks.aif-sai-pro).

Foundry resource fungerer som en beholder for alle prosjekter.

2) Foundry prosjekt

- Åpne ai.azure.com.

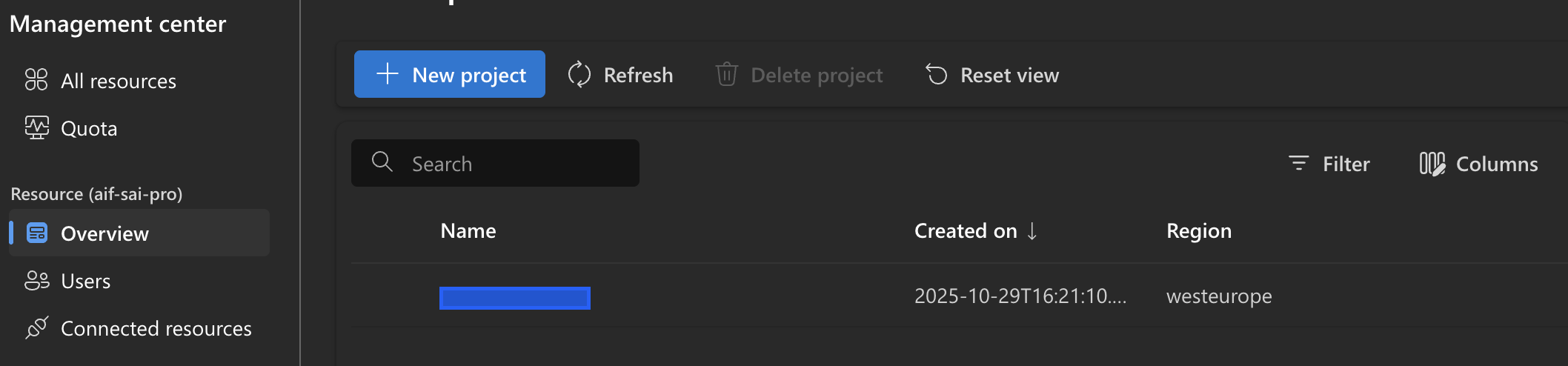

- Til venstre velg Management Center → Projects.

- Klikk på New project.

- Velg eksisterende Foundry resource og skriv inn navnet på prosjektet.

Distribusjon av modeller

Model deployments

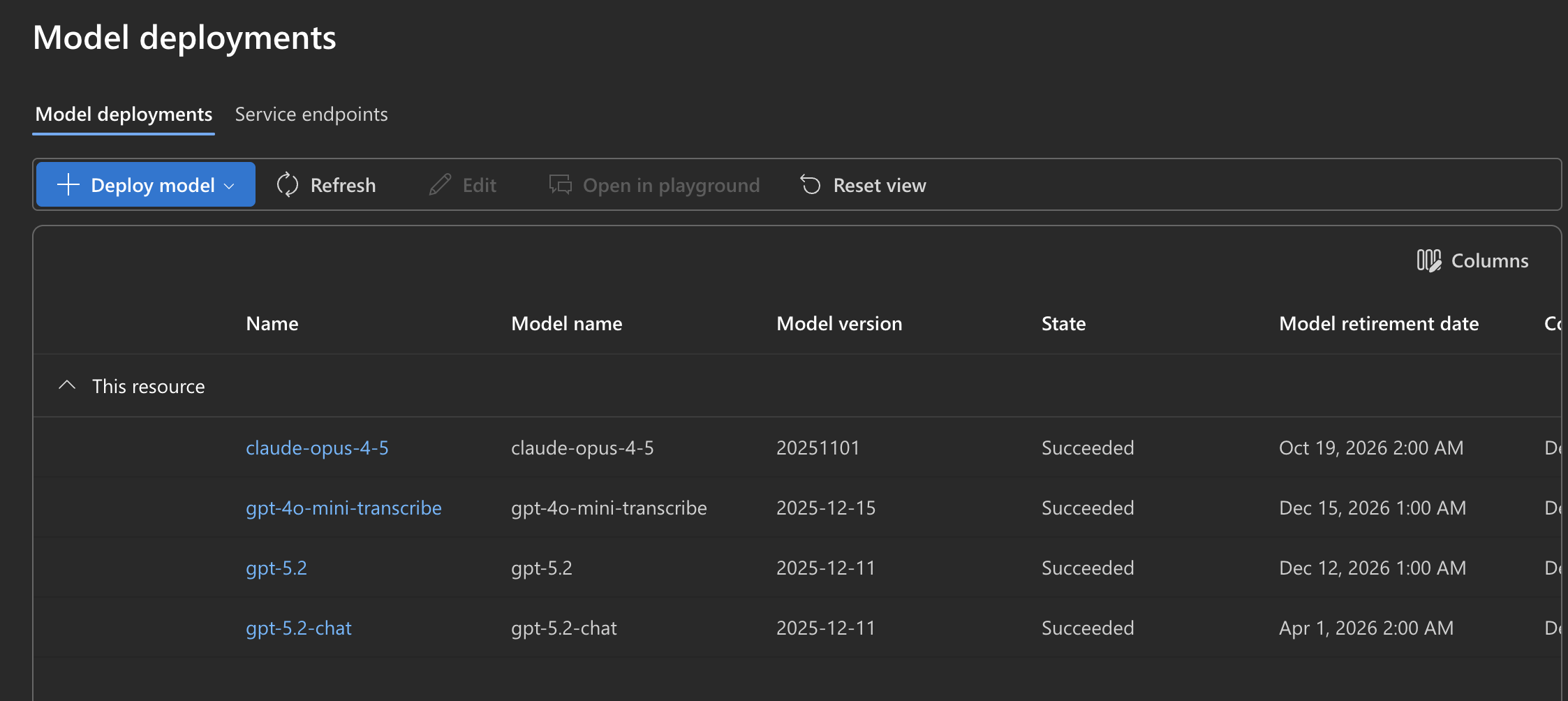

I prosjektet går du til Model catalog → Model deployments og distribuerer tilgjengelige modeller.

Eksempler på distribusjoner:

gpt-5.2gpt-5.2-chatgpt-4o-mini-transcribeclaude-opus-4-5

Hver distribusjon har navn på distribusjonen, modellversjon, status og dato for avvikling.

⚠️ Siesta AI arbeider med navn på distribusjonen, ikke med navnet på modellen.

Endepunkter og API-nøkler

Project endpoint (Foundry API)

Project endpoint brukes for prosjektets kapabiliteter (agenter, evalueringer og Foundry inferens API). Du finner det i prosjektets detaljer.

Format for endpoint:

https://<foundry-resource-name>.services.ai.azure.com/api/projects/<project-id-or-name>

Endepunkter og nøkler i prosjektet

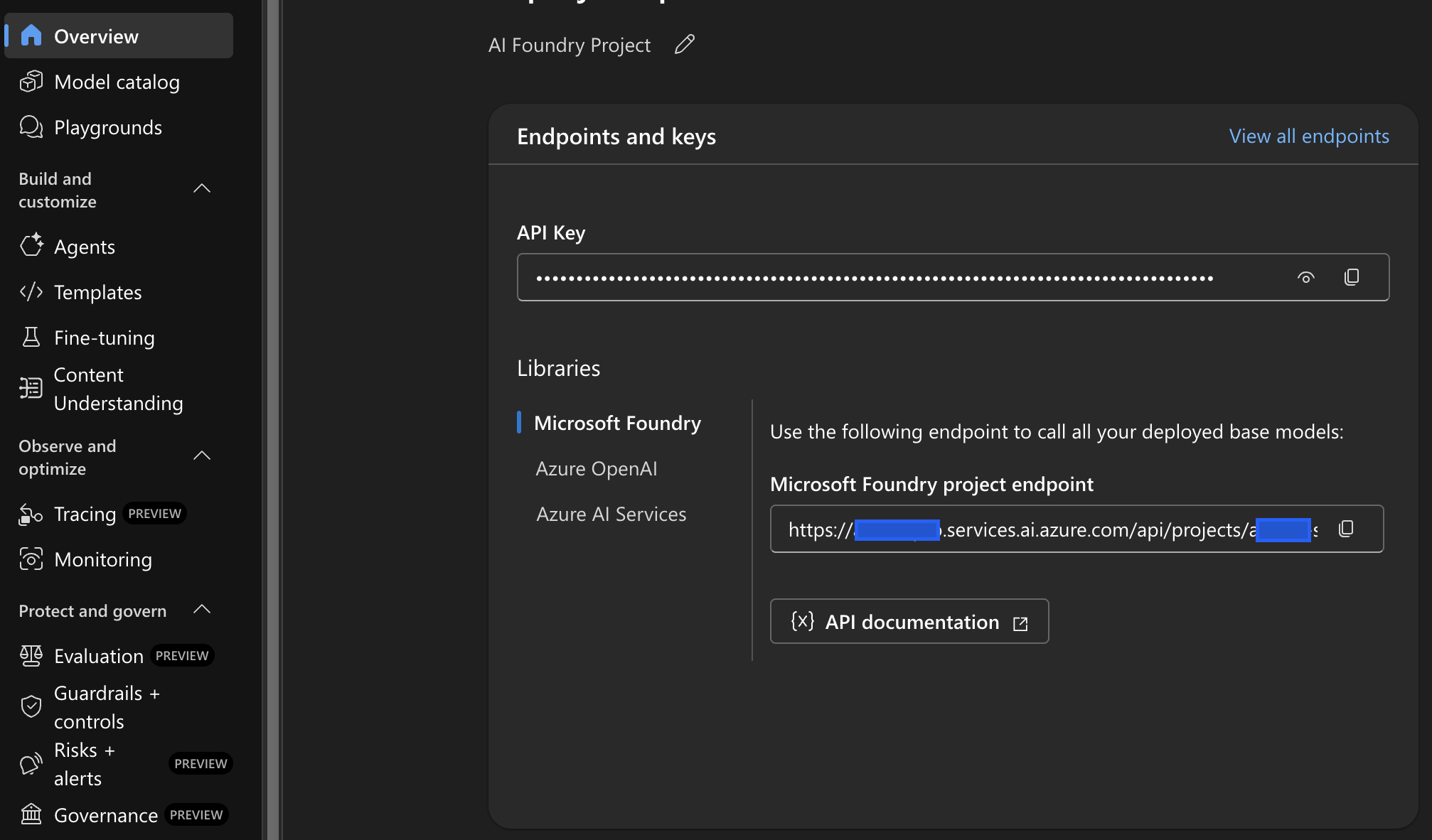

I ai.azure.com åpner du prosjektet og seksjonen Endpoints and keys:

- Microsoft Foundry project endpoint

- API Key for prosjektet

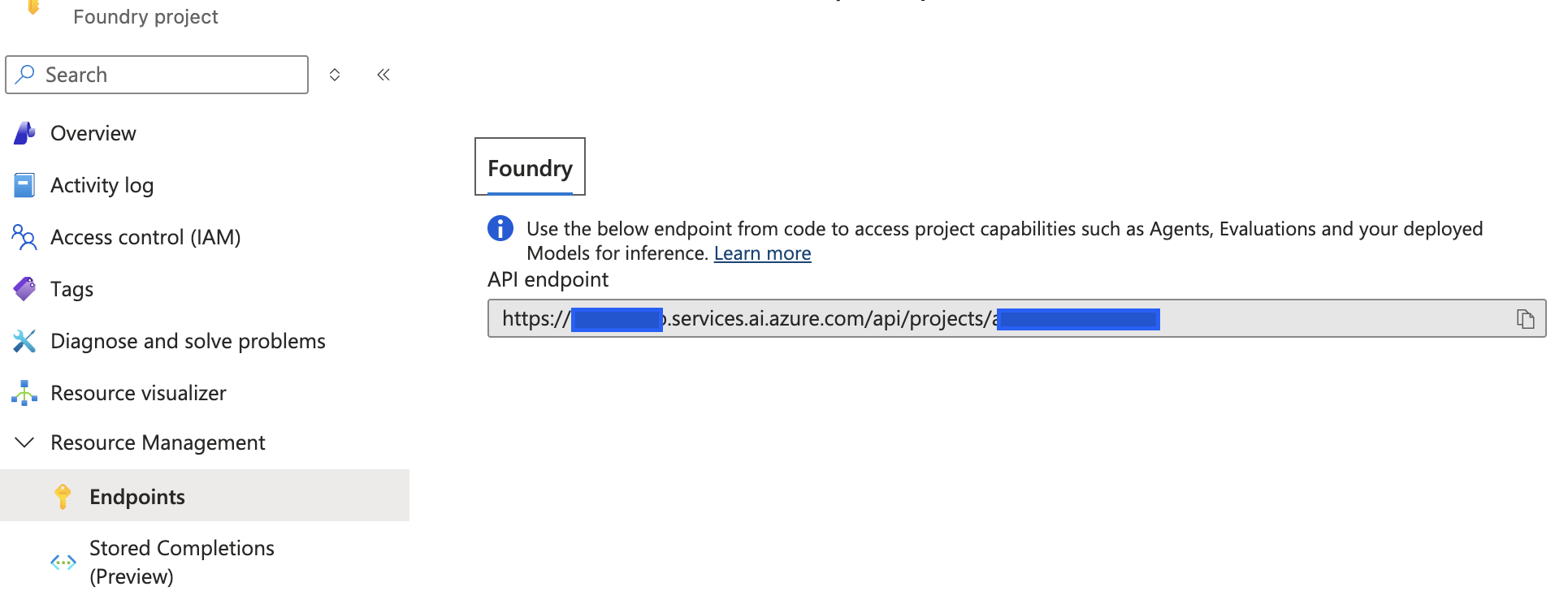

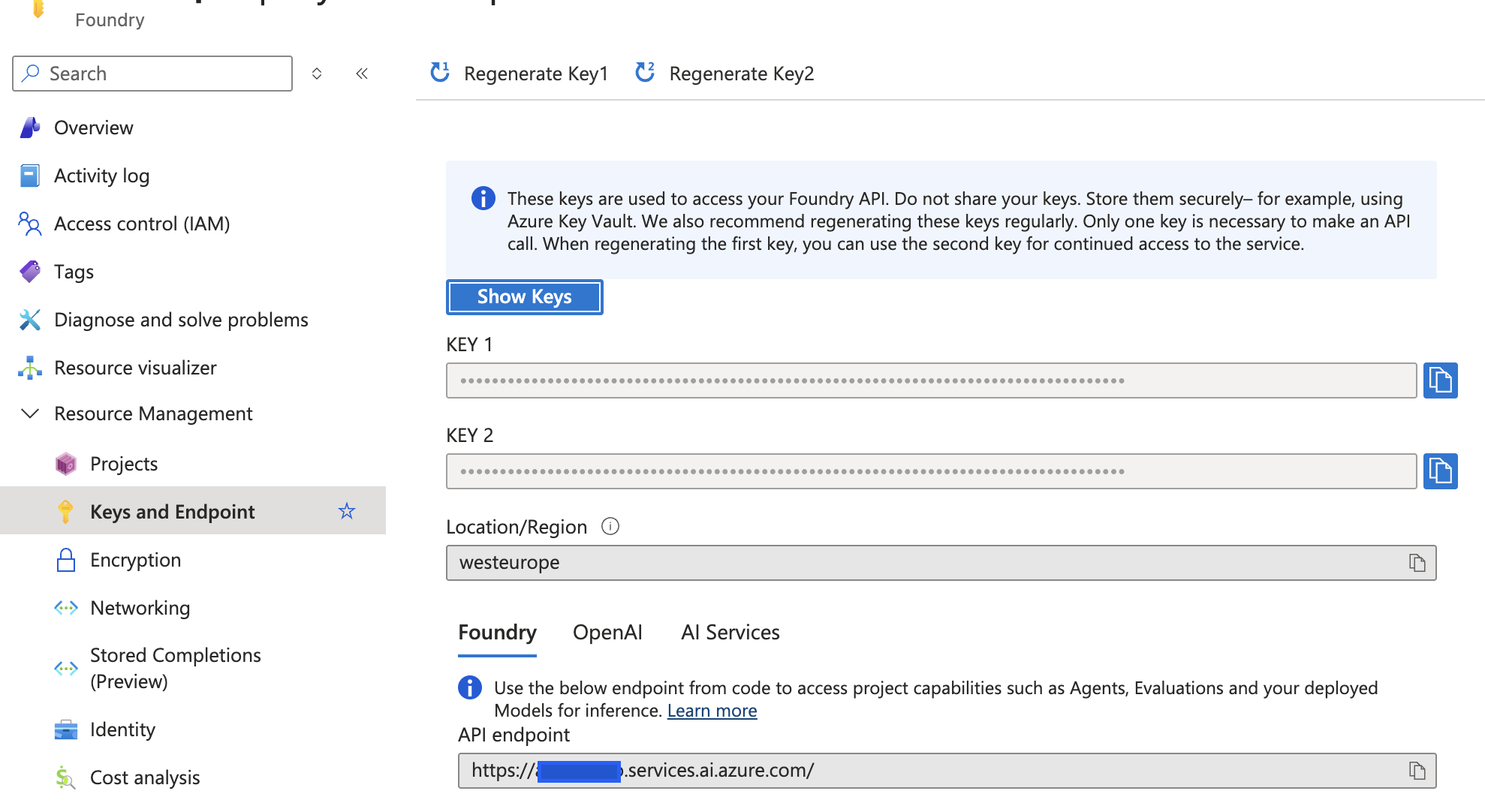

Nøkler og Endepunkt (Azure Portal)

I Azure Portalen på Foundry resource:

- Keys and Endpoint → Foundry

- Key 1 / Key 2 for rotasjon

- Grunnleggende endpoint for ressursen

Koble Azure AI Foundry til Siesta AI

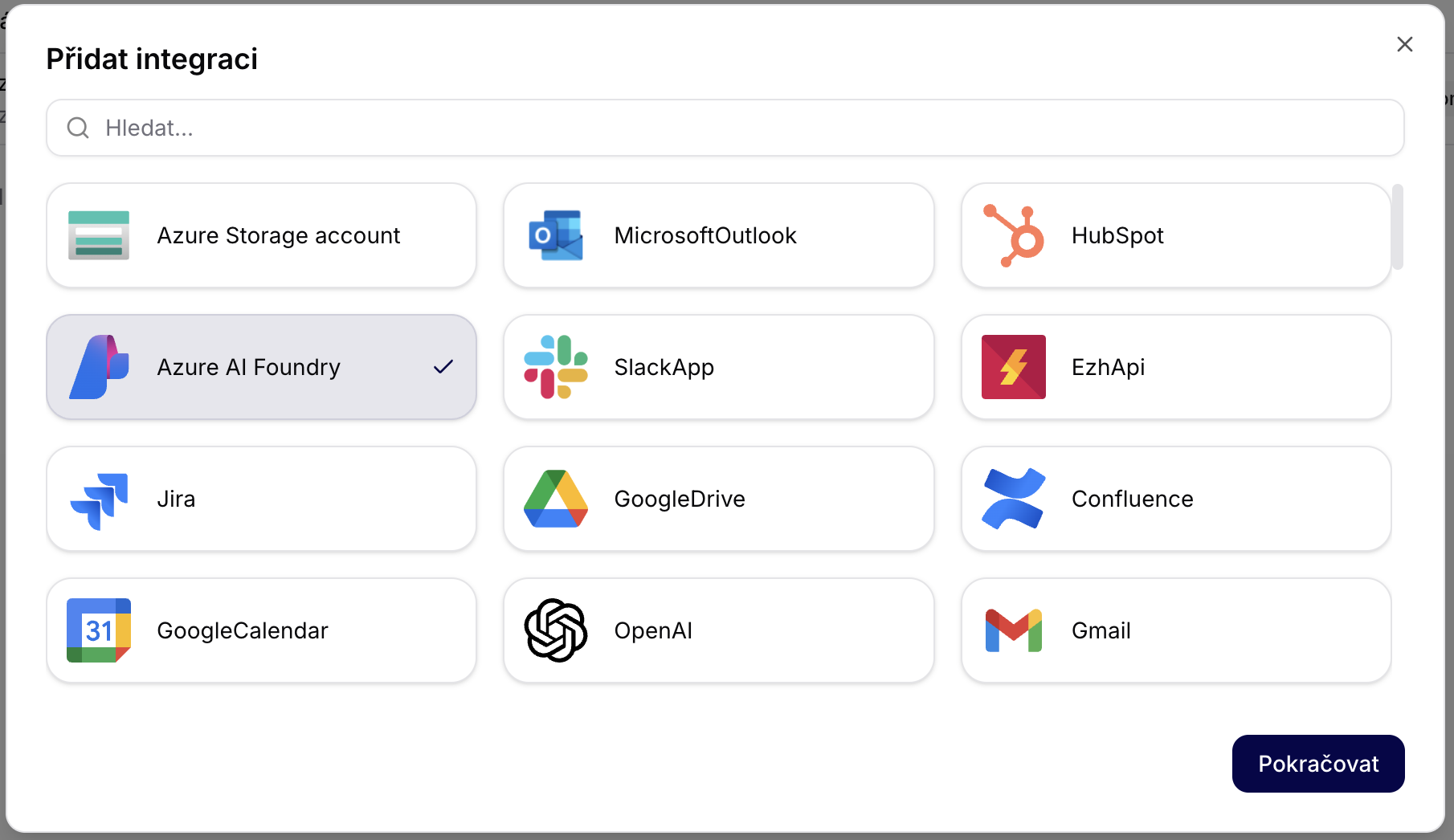

1) Legge til integrasjon

- Logg inn på Siesta AI Admin.

- Åpne Integrations.

- Klikk på Legg til integrasjon.

- Velg Azure AI Foundry.

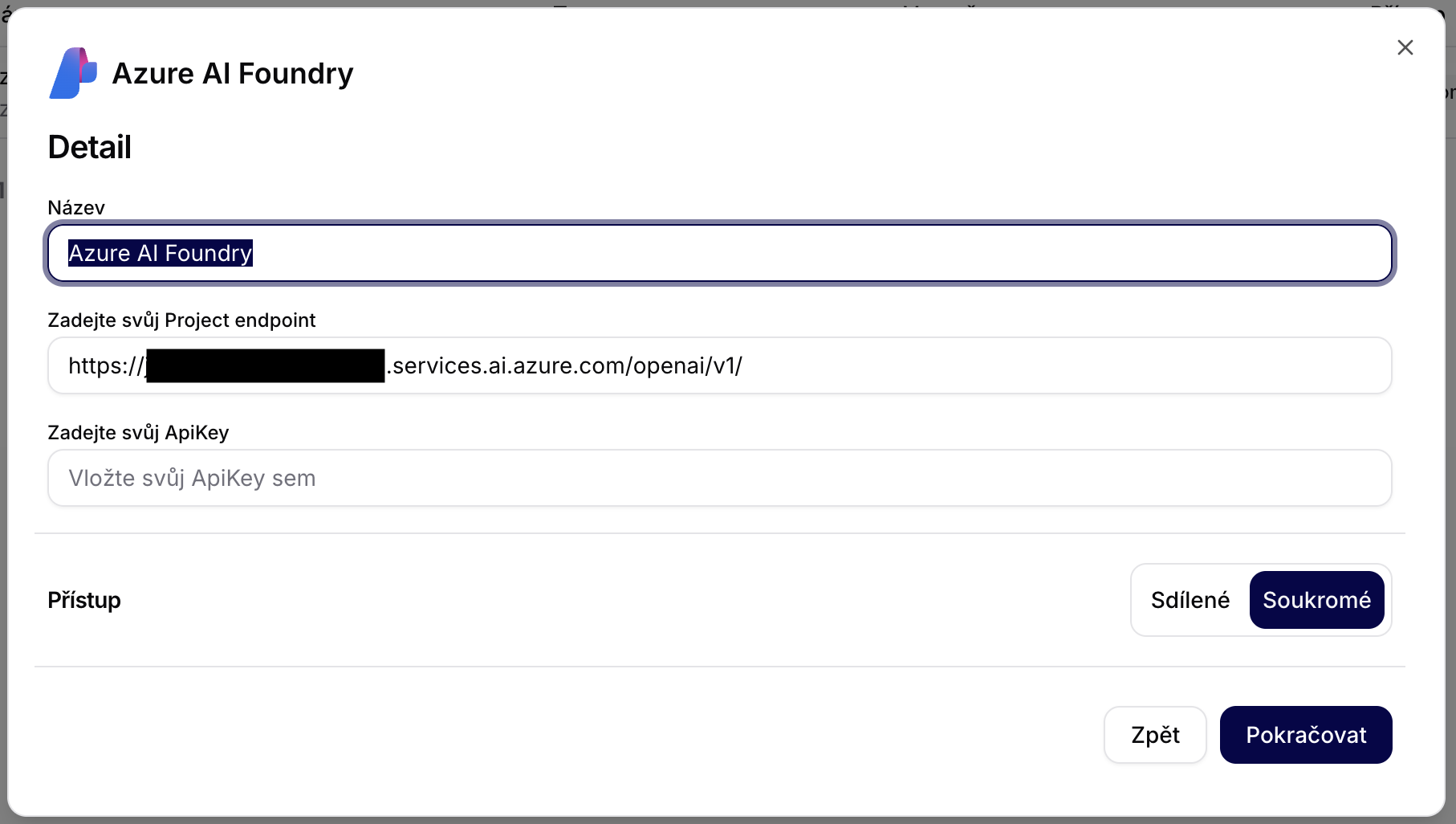

2) Fylle ut detaljene for integrasjonen

Fyll ut:

- Navn: f.eks.

Azure AI Foundry – PROD - Project endpoint (OpenAI-kompatibel):

https://<foundry-resource-name>.services.ai.azure.com/openai/v1/ - ApiKey: bruk API-nøkkelen for prosjektet (fra ai.azure.com) eller nøkkelen fra Azure Portalen.

- Tilgang: Privat (anbefalt)

3) Verifisering av integrasjonen

Etter lagring av integrasjonen:

- Siesta AI vil utføre en valideringstest.

- Endpoint og nøkkel lagres kryptert.

- Integrasjonen er tilgjengelig for assistenter, arbeidsflyter og datainnsamlinger.

Bruk av modeller i Siesta AI

- Åpne Agent / Template / Workflow.

- Velg Model provider: Azure AI Foundry.

- Velg deployment name (f.eks.

gpt-5.2-chat). - Lagre konfigurasjonen.

Sikkerhet & Styring

- Autentisering via API-nøkkel.

- RBAC styrt på Azure-nivå.

- Mulighet for Private Endpoint + VNET.

- Revisjonslogger i Azure Activity Log.

- Overvåking via Foundry + Azure Monitor.

Anbefalt arkitektur

- Én Foundry resource per miljø (DEV / STAGE / PROD).

- Flere prosjekter for team eller kunder.

- Separate model deployments.

- Rotasjon av nøkler via Key Vault.

Økning av kvote

Hvis du trenger å øke kvoten for Azure AI Foundry, bruk dette dokumentet:

Nyttige lenker

- Azure AI Foundry portal: https://ai.azure.com

- Dokumentasjon: https://learn.microsoft.com/azure/ai-studio/

- Model catalog: https://ai.azure.com/model-catalog

- Azure RBAC: https://learn.microsoft.com/azure/role-based-access-control/

Oppsummering

Azure AI Foundry fungerer som en enterprise AI backbone, mens Siesta AI bygger assistenter, arbeidsflyter, datainnsamlinger og integrasjoner med SaaS-systemer over den. Integrasjonen er reviderbar og fullt under kontroll av kunden i Azure.